19 nowości w DaVinci Resolve 19

Imponująca, ponad dwugodzinna prezentacja Granta Petty, CEO Blackmagic Design, podczas tegorocznych targów NAB przyniosła wiele nowości, od urządzeń do produkcji na żywo, kamer, aż po nowy panel do korekcji barwnej i kolejną wersję DaVinci Resolve 19! Kilka dni później emocje już nieco opadły, ale czas pozwolił na bliższe zapoznanie się ze zmianami oraz ich wstępne przetestowanie. W efekcie powstała ta subiektywna lista 19 najciekawszych nowości w DaVinci Resolve 19 wraz z ich krótkim opisem!

FIXED PLAYHEAD NA TIMELINE

Widok ustawionego centralnie i na sztywno Playhead’a jest znany z innych programów do edycji wideo, w DaVinci Resolve był póki co dostępny tylko w zakładce Cut, ale teraz pojawia się również w Edit. Opcję można uruchomić w menu Timeline View Options po lewej stronie paska narzędzi.

PRECYZYJNY TRIM EDITOR W OKNIE PODGLĄDU

Kolejna opcja, która wcześniej była dostępna tylko w Cut, a teraz przechodzi również do Edit. Pozwala ona na precyzyjne przesuwanie klatka po klatce wraz z podglądem pomiędzy dwoma klipami, które się ze sobą łączą. Aby ją uruchomić wystarczy podwójne kliknięcie pomiędzy klipami, lub wybór Trim Editor z menu Trim. Warto pamiętać o skrótach “,” (przecinek) oraz “.” (kropka) do przesuwania o 1 klatkę w lewo i prawo.

EDYCJA PRZY POMOCY TRANSKRYPCJI

W tym przypadku mówimy o kilku nowościach, takich jak m. in. wykrywanie rozmówców w transkrypcji, przypisywanie im nazw, przycinanie klipów poprzez usuwanie słów i przerw pomiędzy wypowiedziami, wyszukiwanie i zamiana słów lub części słów na inne, czy kolumna z kodem czasu w oknie transkrypcji. Wszystkie te nowe funkcje razem z już istniejącymi wydają się być naprawdę ciekawą alternatywą klasycznej edycji, w wielu sytuacjach zwiększającą efektywność pracy, natomiast niestety z perspektywy polskiego edytora dużym minusem jest ciągle brak obsługi naszego rodzimego języka… Szkoda.

ZMIANA USTAWIEŃ KANAŁÓW AUDIO W INSPECTOR

Poprzednio, aby zmienić opcję kanałów danego klipu dźwiękowego, należało dotrzeć do menu Clip Attributes. Teraz jest to możliwe bezpośrednio w Inspector, w zakładce File. Co więcej zmian można również dokonywać w wielu klipach na raz. Dodatkowo jest tam wizualizacja ścieżki i możliwość odsłuchu, również z podziałem na kanały. Natomiast, póki co opcja ta działa tylko dla klipów znajdujących się jeszcze w Media Pool, a nie już na Timeline. Najpewniej jednak pierwszy update rozwiąże ten problem, ponieważ Blackmagic Design twierdzi, że powinno to działać w obu przypadkach.

KRZYWE BEZIERA DLA KLATEK KLUCZOWYCH W OPEN FX

Animacja efektów Open FX w Edit za pomocą klatek kluczowych od teraz jest możliwa również z pomocą krzywych Beziera. Wiadomo, “wygładzone” efekty z reguły wyglądają lepiej!

COLORSLICE

W palecie narzędzi dostępnych w zakładce Color, pomiędzy Curves a Color Warper pojawiło się Colorslice. Niektórzy mogą znać już podobne narzędzia dostępne wcześniej za pomocą pluginów DCTL, ale teraz jest ono natywne. Zasada działania Colorslice polega na wykorzystaniu tzw. sześciu wektorów kolorów, a właściwie siedmiu, ponieważ poza czerwonym, zielonym, niebieskim, żółtym, cyan i magentą jest jeszcze kolor skóry. W ramach każdego wektora (koloru) możemy zmieniać jego kąt, ale przede wszystkim saturację (Saturation) i jasność (Density). Oczywiście są też suwaki globalne Density, Hue i Saturation. Co najważniejsze ta saturacja jest tutaj emulacją tzw. saturacji subtraktywnej (Subtractive Saturation), różniącej się od tradycyjnej saturacji addytywnej (Additive Saturation), używanej standardowo w paletach Primaries i HDR. Dodawanie saturacji subtraktywnej nie zwiększa jasności kolorów, pozwalając na uzyskanie bardziej organicznych i filmowych efektów.

GRUPOWANIE NODE'ÓW

W Project Settings można obecnie zmienić ustawienie tzw. Node Stacks (od 1 do 4) , a nawet nadać im nazwę. Opcja ta pozwala na osobne wyświetlanie konkretnych „części” nodów w zakładce Color na poziomie Clip (np. osobno Primaries, Secondaries, etc.), co razem z funkcją grup pozwala na przejrzystą pracę zwłaszcza na bardzo rozbudowanych tzw. Node Trees. Funkcjonalność Node Stacks można również kreatywnie wykorzystać do kopiowania i wklejania części korekcji pomiędzy klipami.

FILM LOOK CREATOR

Ten nowy efekt FX już w trakcie prezentacji wersji 19 był porównywany do innego, ale zewnętrznego pluginu o nazwie Dehancer. W odróżnieniu od niego Film Look Creator nie zawiera jednak gotowych presetów z emulacją taśm filmowych. Natomiast jego wbudowane opcje sprawiają, że praktycznie w jednym miejscu można zbudować własny, zawierający wszystkie elementy powszechnie postrzegane jako tzw. look filmowy. Można zatem zmieniać transformację przestrzeni kolorystycznej (Color Space Transform), wpływać na obraz poprzez liczne suwaki, m. in. fotometryczną ekspozycję (Exposure), subtraktywną saturację (Saturation), czy nawet wprowadzać efekt tzw. Bleach Bypass. Ponadto dostępne są choćby takie opcje jak winieta (Vignette), halacja (Hallation), szum (Grain), czy różne formaty (Filmgate). Dodatkowo efekt zawiera opcję sprawdzającą możliwość zastosowania danych ustawień w kontekście możliwości eksportu do tabeli 3D LUT (3D LUT Compatible).

NORMALIZACJA KANAŁÓW W MIKSERZE RGB

Mikser RGB to niedoceniane narzędzie, które świetnie sprawdza się np. przy trudnych ujęciach z dominantą światła w danym kolorze. Używając go można skorzystać m. in. z opcji Preserve Luminance, dzięki której utrzymywany jest poziom jasności dla wszystkich kanałów. Natomiast chcąc dokonywać zmian w danym kanale nie wpływając na pozostałe i jednocześnie utrzymywać poziom luminancji, uprzednio należało odznaczyć Preserve Luminance i ręcznie kompensować zmiany RGB wewnątrz tego kanału. Od teraz to się zmienia dzięki możliwości automatycznej normalizacji dla każdego kanału z osobna.

PORZĄDKOWANIE STRUKTURY NODE'ÓW DLA WIELU KLIPÓW

Czasami struktura node’ów w Color, np. po skopiowaniu całej korekcji z innego klipu, staje się nieuporządkowana i mało przejrzysta. Łatwo temu zaradzić dzięki opcji Cleanup Node Graph, natomiast jeśli dotyczy to wielu klipów, operację trzeba powtórzyć dla każdego z osobna. W DaVinci Resolve 19 możliwe jest już wykonanie “porządkowania” dla wielu klipów na raz. Wystarczy zaznaczyć odpowiednie klipy, a następnie na klikając prawym przyciskiem na polu struktury node’ów jednego z nich i wybrać Cleanup Selected Node Graphs.

ULEPSZENIA FACE REFINEMENT

To narzędzie umożliwia teraz detekcję więcej niż jednej osoby (twarzy), ale przede wszystkim pozwala na ręczną korekcję trakowania, interpolację klatek kluczowych i dodaje więcej opcji dotyczących retuszu twarzy.

OBSŁUGA ZARZĄDZANIA KOLOREM W OKNIE PODGLĄDU FUSION

W przypadku używania zarządzania kolorem na poziomie ustawień Timeline, zwłaszcza w przypadku DaVinci WG/Intermediate jako Timeline Color Space, pomimo różnego rodzaju “ręcznych” rozwiązań nigdy nie było 100% pewności co do zgodności podglądu wewnątrz i na zewnątrz Fusion. Teraz ma się to zmienić! Uff…

NARZĘDZIE MULTIPOLY

Nowe narzędzie MultiPoly w Fusion umożliwia tworzenie wielu masek wraz z ich odrębną kontrolą w ramach jednego Node’a, co znacznie ułatwi pracę np. przy rotoskopii. Nie trzeba już będzie tworzyć odrębnych node’ów!

DO TRZECH RAZY SZYBSZE MASKOWANIE MAGIC MASK W FUSION

Blackmagic Design deklaruje, że użycie Magic Mask w Fusion w DaVinci Resolve 19 zapewnia do trzech razy lepszą wydajność tego narzędzia. No cóż, chyba trzeba to przyjąć jako dobrą wróżbę, zwłaszcza, że Magic Mask potrafi być zasobożerne, ale jak mało inne narzędzie oszczędza masę czasu przy zadaniach rotoskopii.

NOWY TRAKER PUNKTOWY INTELLITRACK

Nową domyślną metodą trakowania w Fusion Tracker jest teraz IntelliTrack. Jest to nowa, oparta na DaVinci Neural Engine metoda trackowania, która wg. Blackmagic Design jest dużo bardziej dokładna niż “standardowy” traker punktowy. No cóż, trzeba go dłużej potestować, żeby w pełni potwierdzić, ale jest to obiecujące!

AUTOMATYCZNA KOREKTA GŁOŚNOŚCI (DUCKING)

Automatyczna korekta poziomu głośności ścieżki dźwiękowej względem dialogowej to jedna z tych możliwości, na które chyba wszyscy czekali. Owszem, można było już wcześniej osiągnąć ten efekt poprzez pewne funkcje w Fairlight, ale z pewnością nie było to bardzo proste i intuicyjne. W DaVinci Resolve 19 to się zmieniło. Ducker jest dostępny zarówno w Fairlight, jak i Edit. Ścieżka dialogowa stanowi źródło (Duck Source). Jeśli jest ich więcej niż jedna, można je połączyć w tzw. szynę (Bus) i to ona wówczas stanowi owe źródło. Natomiast ścieżka, na którą chcemy wpływać może być tylko jedna (może się to zmieni w kolejnych update’ach?). Narzędzie pozwala na dostosowanie efektu poprzez kilka pokręteł, m. in. Duck Level, Lookahead, Rise Time, itd. Nareszcie!

DIALOG SEPARATOR I MUSIC REMIXER

Oba te narzędzia pozwalają na inteligentne odizolowanie i zmianę “składowych” ścieżki dźwiękowej; w przypadku Dialog Separator mowa tu oczywiście o mowie, jak i pozostałych odgłosach tła, efektu echa czy samego tzw. ambientu. Tu jedna uwaga; Dialog Separator obsługuje tylko ścieżki mono, więc ścieżkę stereo należałoby rozbić na dwie osobne mono i zastosować efekt dwa razy. Z kolei w przypadku Music Remixer mowa o warstwach wokalu, perkusji, basów, gitar i pozostałych dźwięków.

AUTOMATYCZNY DŹWIĘK PRZESTRZENNY NA PODSTAWIE INTELLITRACK

Wspomnianą wcześniej nową metodę trakowania można również wykorzystać w Fairlight, a śledzone osoby czy przedmioty mogą posłużyć jako dynamicznie poruszające się źródło dźwięku automatycznie tworząc efekt dźwięku przestrzennego.

INNE

Nie wchodząc w szczegóły z pewnością warte zauważenia są również Reference Fusion Composition, odzyskiwanie z backup’u usuniętych Timeline, ale też możliwość wykupienia licencji Studio nawet na jeden miesiąc, czy opcja Replay dla produkcji na żywo. Dodatkowo z pewnością interesującym produktem powiązanym z DaVinci Resolve, zwłaszcza dla osób rozpoczynających przygodę z korekcją barwną, jest nowy panel Micro.

PODSUMOWANIE

To oczywiście nie wszystkie nowości, jest ich zdecydowanie więcej, natomiast część z nich jest zarezerwowana tylko dla wersji Studio (kolejny powód żeby rozważyć zakup)! Pamiętajcie też, że w momencie publikacji tego wpisu DR19 jest w wersji beta, więc mogą pojawić się różnego rodzaju niestabilności w działaniu. Z tego powodu praca z konkretnymi projektami dla klientów już teraz jest ryzykowna. Zapewne za dwa-trzy tygodnie pojawi się pierwszy update, a później kolejne. No i stała rada przy każdej tego typu sytuacji; przed aktualizacją wykonajcie kopię bazy danych, ponieważ po przekonwertowaniu jej do obsługi wersji 19 nie ma już możliwości powrotu do 18.6.

Wszystkie zaprezentowane nowości są kolejnym uzupełnieniem niesamowitej gamy narzędzi już wcześniej dostępnych w DaVinci Resolve, zachęcam zatem do sprawdzenia również innych wpisów z serii “Quick Tips”. No i oczywiście, jeśli ktoś miałby ochotę rozszerzyć swoją wiedzę podczas zajęć indywidualnych, serdecznie zapraszam, więcej informacji tutaj.

Poradnik DaVinci Resolve #4

W zeszłym roku Blackmagic Design nieco zaskakująco zamiast 19 wydał wersję 18.5, która po wyjściu z bety otrzymała następnie aktualizację do 18.6. Zmiany w programie nie polegały tym razem na wprowadzeniu wielu nowych funkcji, ale skupiono się na wydajności, zarówno w kontekście istniejących modułów, jak i znacznie ulepszonej możliwości zespołowej pracy w chmurze. Pora zatem zaprosić na kolejną porcję porad z serii “Quick Tip”!

BANALNE USUWANIE NIEUŻYWANYCH KLIPÓW W MEDIA POOL

To jest jedna z tych nowości, które pojawiły się w wersji 18.6 i naprawdę ułatwia życie! Proces edycji czasami bywa… burzliwy, a w Media Pool pojawia się masa klipów, zdjęć, itp., które ostatecznie nie trafia na Timeline. Aby uporządkować cały projekt przed archiwizacją, bądź przesłaniem np. do korekcji barwnej można było do tej pory skorzystać np. z funkcji Smart Filter, ale teraz jest to o wiele prostsze, wręcz banalne. Otóż w menu Media Pool (trzy kropki) pojawiła się opcja Remove Unused Clips… Algorytm bierze pod uwagę wszystkie Timeline’y, w tym m. in. Compound Clips, Fusion Compositions, itd., a cała operacja w zależności od złożoności projektu może potrwać nawet kilka minut. I gotowe!

SPRYTNE DZIAŁANIE INSTANCE NODE W FUSION

Praca w zakładce Fusion odbywa się na tzw. nodach (node), których gęsta siatka często przeraża i zniechęca początkujących użytkowników. Taki system ma jednak bardzo wiele zalet. Dla przykładu, rozbudowując swój zaawansowany efekt wizualny, czy animację można szybko dojść do sytuacji, w której z różnych względów pojawi się potrzeba wykorzystania pewnych wartości (i ewentualnie ich zmian) w różnych miejscach równocześnie. W Fusion nie ma problemu! Oto jakie są możliwości:

– kolejne połączenie outputu danego noda i użycie go w niezmienionej formie, co jest wygodne, bo wszystkie zmiany nanoszone są tylko w jednym nodzie, aczkolwiek nie ma możliwości zmiany pomiędzy outputami,

– skopiowanie i wklejenie kopii noda (Ctrl + C / Ctrl + V), co oczywiście daje możliwość zmiany dowolnego parametru, ale wiąże się z kontrolowaniem wszystkich parametrów (również tych nie zmienionych) w ramach tego nowego noda osobno,

– lub skopiowanie i wklejenie tzw. instancji noda (Ctrl + C / Ctrl + Shift + V), co również daje możliwość zmiany dowolnego parametru, ale pozostawia kontrolę pozostałych poprzez node „macierzysty”.

Aby to bardziej wyjaśnić; po skopiowaniu instancji noda, np. Text1, powstaje połączony z nim node Instance_Text1, o czym świadczy cienka zielona pomiędzy nimi. Można się o tym również przekonać otwierając okno Inspector, gdzie wartości poszczególnych parametrów umieszczone są w specjalnych zielonych ramkach. To połączenie polega na tym, że jeżeli zmieniony zostanie np. rozmiar tekstu (Size) w Text1, automatycznie taką wartość przyjmie również Size w Instance_Text1, i na odwrót. Będzie się tak działo, dopóki dany parametr nie zostanie odłączony od tego macierzystego, co można uzyskać poprzez opcję Deinstance (prawy przycisk myszy obok danego parametru). Instance node daje wiele sprytnych możliwości pozwalających na przyśpieszenie pracy, zwłaszcza kiedy kompozycja ma zostać zapisana do ponownego wykorzystania w postaci makro.

Warto wspomnieć, że do łączenia wartości parametrów różnych nodów można wykorzystać również funkcję Expression, ale ma ona dużo szersze zastosowanie, więc o niej innym razem.

PODWÓJNY TIMELINE SPOSOBEM NA SZYBSZY MONTAŻ?

Niezwykle ważnym początkiem procesu montażu filmowego jest zawsze właściwa selekcja materiałów przy imporcie do Media Pool. Klasycznie montażysta przygotowuje odpowiednią i logiczną strukturę katalogów i umieszcza w nich klipy (lub nawet sub-klipy), a dopiero później zaczyna układać je na “głównym” Timeline. Dlaczego jednak nie pójść krok dalej i… tworzyć najpierw osobne Timeline’y dla każdego katalogu układając na nich materiały na „różnych poziomach” w zależności od ich “przydatności”, to jest np. najniżej na ścieżce 1 klipy, które tylko „ewentualnie” nadają się do końcowej „układki”, najwyżej na ścieżce 3 te, które są najlepsze i muszą wejść do montażu, a na ścieżce 2 te pomiędzy. To oczywiście tylko jeden ze sposobów selekcji. Takie podejście pozwala natomiast wykorzystać przy montażu możliwość dodania do interfejsu drugiego Timeline (lub ewentualnie również kolejnych), a co za tym idzie szybkiego przełączania się pomiędzy aktywnymi Timeline’ami i przeciągania klipów na Timeline „główny”, co potencjalnie znacznie przyśpieszy cały proces montażu. Jak to zrobić?

W zakładce Edit na wysokości paska narzędzi takich jak Selection Mode, Trim Edit Mode etc. po lewej stronie znajduje się ikona Timeline View Options. Po jej kliknięciu otwiera się menu, gdzie jedną z opcji jest Stacked Timelines. Umożliwia ona dodawanie kolejnych zakładek, czyli Timeline’ów (ikona z „+”). Tam można otworzyć Timeline’y utworzone na podstawie katalogów Media Pool. Co ważne, Stacked Timelines uruchamia także inną możliwość dodawania kolejnego Timeline’u, ale już nie jako zakładki, ale drugiego (kolejnego) Timeline’u widocznego równocześnie poniżej obecnego (tym razem ikona na tej samej wysokości interfejsu, ale całkiem po prawej, również z „+”). Tu właśnie można otworzyć Timeline „główny”. Taki układ pozwala na szybkie przełączanie się pomiędzy zakładkami Timeline’ów z Media Pool i przeciąganie materiałów poniżej na Timeline „główny”.

Czy jest to idealny sposób na przyśpieszenie montażu? Na pewno daje on spore możliwości i z pewnością warto go wypróbować, ale na końcu i tak najważniejsze są indywidualne preferencje montażysty!

BRAK KLIPÓW PRZY RENDERZE INDIVIDUAL CLIPS

Dość często na forach internetowych związanych z DaVinci Resolve pojawia się pytanie dotyczące braku niektórych klipów po renderze z opcją “Individual clips” (dla przypomnienia Single clip oznacza jeden plik z “wszystkimi” klipami, a Individual clips osobne pliki). W zakładce Deliver tuż poniżej wspomnianych opcji Single/Individual są trzy zakładki dotyczące ustawień Video, Audio oraz File. Wydaje się, że wiele osób jakoś ich nie zauważa, ponieważ właśnie w zakładce File można dokonać ustawień dotyczących pliku/ów. W przypadku renderu Individual clips i Filename uses: Source name w zakładce File różne klipy z tego samego klipu źródłowego z powodu tej samej nazwy zostaną po prostu nadpisane. Wystarczy zaznaczyć więc Use unique filenames i po kłopocie!

Recenzja follow focus'a Tilta Nucleus Nano II

Kiedy w 2018 roku Tilta zaprezentowała bezprzewodowy zestaw follow focus Nucleus Nano jako bardziej przystępną cenowo alternatywę większego Nucleus’a M, z miejsca zyskał on popularność wśród twórców, którzy cenili sobie używanie manualnych obiektywów filmowych dysponując równocześnie nieco mniejszym budżetem. Zarówno samo pokrętło, jak i napęd dzięki swojej kompaktowej budowie mogły być stosowane bezpośrednio na kamerze czy gimbalu, jak i klasycznie wraz z monitorem podglądowym podczas pracy focus puller’a. Z kolei moment obrotowy napędu był nominalnie wystarczający, aby używać go z większością obiektywów. Nie ma jednak produktów idealnych i Nucleus Nano również miał swoje problemy. Czy odpowiedzią na nie jest Nucleus Nano II, model zaprezentowany wiosną tego roku, który właśnie wchodzi do sprzedaży również w Polsce? Tak się składa, że oryginalny Nano był używany na planach Kaktus.studio przez ostatnie dwa lata, natomiast nowy co prawda dopiero od dwóch tygodni, ale już po tak krótkim czasie można pokusić się o odpowiedź, że nie tylko rozwiązuje on problemy poprzednika, ale także wnosi nową jakość! Ale po kolei.

JAKOŚĆ WYKONANIA I DESIGN

Po wyjęciu produktu z ochronnego etui pierwsze wrażenia są jak najbardziej pozytywne; zarówno napęd jak i pokrętło wydają się być dobrze wykonane, solidne, a przy tym eleganckie. Napęd, być może delikatnie mniejszy niż poprzedni przede wszystkim nie ma już wyświetlacza led, ma natomiast fizyczny przycisk, małą lampkę sygnalizującą funkcję oraz pokrętło pozwalające na obrót zębatki (0.8 m). No i co bardzo istotne, zamiast problematycznego gniazda Micro USB – posiada dwa gniazda USB-C.

Natomiast zdecydowanie większe różnice dotyczą pokrętła. Choć nowy model cechują podobne rozmiary fizyczne, to zamiast elementów z drewna proponuje on czerń, nie ma małej białej obręczy do oznaczenia markerów i przede wszystkim posiada spory ekran dotykowy, z którego można sterować różnymi funkcjami urządzenia. Zrezygnowano również z wymiennej baterii, która teraz jest wbudowana. Dodatkowo na pokrętle znajduje się gniazdo USB-C, dwa, a właściwie trzy przyciski fizyczne, a z tyłu mocowanie korzysta z rozwiązania popularnej szyny NATO.

Ponadto w etui znajduje się wałek 15 mm wraz z mocowaniem do klatki, krótki kabel USB-C – USB-C oraz regulowany pasek z ząbkami do mocowania na obiektywach fotograficznych.

NOWY NAPĘD

Problemy, których sam doświadczałem podczas używania pierwszej wersji Nano wiązały się przede wszystkim z jego zasilaniem. Otóż port Micro USB nie był chyba najszczęśliwszym rozwiązaniem, z jakichś powodów często napięcie, które udawało się ostatecznie uzyskiwać to jedyne 5V, a próbowałem różnych kabli i powerbanków. Dopiero dokupiony (i nie tani) kabel Tilty i podpięcie do baterii V-Lock pozwoliło na wyższe wartości, a tym samym wyższy moment obrotowy silnika. Widziałem jednak na forum, że niektórzy użytkownicy mimo to narzekali na pracę z obiektywami, których obręcze obracają się z większym niż zwykle oporem. Tymczasem nowy napęd, jak twierdzi producent proponuje aż pięć razy większy moment obrotowy. Ciężko to obiektywnie sprawdzić, ale obecnie można nawet regulować poziom tej „mocy” w menu dostępnym na pokrętle i mogę stwierdzić, że już na najniższym poziomie z obiektywami Irix Cine silnik radzi sobie doskonale. Korzystając z dołączonego kabla USB-C – USB-C wyższe napięcie bez problemu udaje się uzyskać z powerbanków czy baterii V-Lock. Napęd uzbrojony jest nawet w dwa porty USB-C, z czego jeden może przekazywać napięcie do ewentualnego kolejnego napędu.

Inni użytkownicy pierwszego Nano dodatkowo wskazywali również, że po dłuższym użytkowaniu obniżała się jasność wyświetlacza uniemożliwiająca jego odczyt, a tym samym ustawienie odpowiedniego kanału komunikacji. W Nano II zrezygnowano z wyświetlacza, a kanał komunikacji wybierany jest poprzez menu pokrętła. Na silniku znajduje się za to wspomniana wcześniej lampka sygnalizująca kolorem różne funkcje, m. in. cztery tryby działania: fioletowy – fokus, niebieski – zoom, zielony – przysłonę oraz żółty – inne, funkcję prawdopodobnie przewidzianą do obsługi zmiennych filtrów matte box’a Tilta Mirage.

Kolejnym problemem, szczerze mówiąc nie wiem czy wynikającym z pracy napędu czy pokrętła był fakt, że oba elementy nie mogły znajdować się tuż obok siebie, ponieważ wówczas zestaw po prostu przestawał działać. Było to frustrujące zwłaszcza w przypadku samodzielnego kręcenia z ręki, kiedy pokrętło mocowane na kamerze siłą rzeczy mogło znajdować się blisko silnika. W nowym Nano II ten problem już nie występuje.

Na koniec warto wspomnieć, że na silniku znajduje się pokrętło umożliwiające przesunięcie zębatki, co ułatwia dopasowanie przy montażu, oraz przycisk uruchamiający funkcję parowania z pokrętłem, zmianę trybu pracy lub gotowość do aktualizacji oprogramowania.

NOWE POKRĘTŁO OSTROŚCI

Ciężko stwierdzić, że pokrętło ostrości poprzedniego Nuclesa Nano sprawiało jakieś konkretne problemy, ale większość użytkowników pewnie i tak zgodnie podzieli opinię, że wybór dosyć nietypowej baterii do zasilania oraz jej ładowanie nie należały do zalet urządzenia. Można się również przyczepić do dosyć wąskiej białej obręczy do oznaczania markerów, czy wymagającego specjalnej przejściówki nietypowego mocowania… Co w takim razie proponuje pokrętło ostrości Nucleus’a Nano II? Okazuje się, że w tym przypadku to już nawet nie jest do końca precyzyjne określenie, ponieważ można nim sterować nawet dwoma wybranymi funkcjami, np. ostrością i przysłoną (oczywiście dysponując dwoma silnikami)! Oto jego najważniejsze cechy:

- wbudowana bateria pozwalająca na pracę przez 20 godzin (wg. producenta, moim zdaniem to raczej 9-10 godzin), z możliwością szybkiego ładowania poprzez port USB-C,

- jasny ekran dotykowy z dostępem do wielu funkcji urządzenia (o czym dalej),

- przycisk funkcyjny, który m. in. uruchamia kalibrację obiektywu lub dodaje marker,

- przycisk funkcyjny uruchamiający i zatrzymujący nagrywanie,

- przycisk włączający/wyłączający fizyczne ograniczniki regulacji pokrętła,

- ruchomy przycisk pozwalający sterować drugim napędem,

- mocowanie do szyny NATO z tyłu pokrętła.

Nowy Nucleus Nano pozwala zatem zapomnieć o nietypowych bateriach i jej ładowarce, pełne ładowanie wewnętrznego akumulatora pozwala na korzystanie z Nucleusa praktycznie przez cały dzień zdjęciowy. Dodatkowo ekran dotykowy wskazuje poziom naładowania, a dzięki funkcji PD Fast Charging można go w czasie przerwy momentalnie uzupełnić.

Dotykowe menu dostarcza całą masę funkcji, których wcześniej nie było, choćby wcześniej wspomnianą regulację momentu obrotowego silnika. Ciężko tu o wszystkich wspomnieć, nie wszystkie testowałem, nie wszystkie też chyba już działają i pewnie ulegnie to zmianie przy następnych aktualizacjach oprogramowania, ale zdecydowanie warto podkreślić następujące:

- możliwość oznaczania „elektronicznych” markerów; podczas przekroczenia danego markera przy zmianie pozycji pokrętła odczuwana jest wibracja (również o regulowanej sile), co zdecydowanie ułatwia ostrzenie operatorom pracującym w pojedynkę,

- możliwość oznaczenia zakresu z twardymi ogranicznikami, co w przypadku niektórych obiektywów pozwala na bardziej płynne zmiany np. fokusa,

- możliwość zmiany kierunku pracy pokrętła,

- możliwość m. in. uruchomienia/zatrzymania nagrywania oraz zmiany przysłony, ISO i migawki dla wybranych modeli aparatów/kamer,

- możliwość zapamiętywania parametrów kalibracji konkretnych obiektywów,

- możliwość zmiany rotacji wyświetlacza, jego jasności czy czasu wygaszania.

KOMPATYBILNOŚĆ

Kolejną zaletą nowego Nucleus Nano jest jego kompatybilność; wg producenta zestaw współpracuje z Nucleus’em Nano N (przetestowałem i potwierdzam), Nucleus’em Nano M, jak również z DJI RS2 i RS3, oraz z wybranymi modelami aparatów i kamer (lista aktualizowana na stronie Tilta). Dodatkowo wkrótce dostępny będzie kolejny kompatybilny produkt – specjalna rączka pozwalająca na mocowanie pokrętła i kontrolę łącznie do 4 napędów.

PODSUMOWANIE

Zaczynając od końca, czyli od ceny; na ten moment zakup Nucleus’a Nano II, którego dostępność w sklepach rośnie, to wydatek na poziomie 1600 zł, a więc bardzo porównywalnie jak w przypadku poprzedniej wersji. Biorąc to pod uwagę, oraz fakt, że nowa wersja nie tylko rozwiązała bolączki poprzedniej, ale zaoferowała wiele więcej wydaje mi się, że to produkt zdecydowanie godny polecenia! Komu? Myślę, że przede wszystkim tym, którzy dopiero chcą wejść w świat obiektywów filmowych i ostrzyć ręcznie. Ale nawet posiadając już pierwszą wersję funkcjonalność Nano 2 przy jednoczesnej możliwości wykorzystania poprzedniego napędu jako drugiego jest bardzo kusząca.

Calibrite ColorChecker Passport Video

ColorChecker, inaczej wzorzec kolorów, to narzędzie które powinno znajdować się w arsenale każdego filmowca i fotografa na planie, a jego wartość można szczególnie docenić w postprodukcji. Świadome używanie wzorca to część szerszego procesu, zwanego zarządzaniem kolorem (color management), który zaczyna się w momencie rejestracji obrazu na matrycy kamery lub aparatu, a kończy reprodukcją na ekranie monitora lub wydrukiem zdjęcia. Na rynku dostępne są wzorce różnych marek, ale ta najbardziej znana, będąca swojego rodzaju synonimem wzorca kolorów to X-Rite, a obecnie po zmianie nazwy Calibrite. W portfolio Calibrite znajdują zarówno urządzenia do kalibracji monitorów i drukarek, jak i właśnie wzorce kolorów, występujące w różnych rozmiarach i dedykowane do niedawna osobno filmowcom i fotografom. Jednym z takich wzorców jest ColorChecker Passport Video, który zawsze znajduje się na planie w Kaktus.studio.

COLORCHECKER PASSPORT VIDEO

Ten wzorzec, zaprojektowany dla twórców filmowych, od pozostałych zdecydowanie wyróżnia rozmiar oraz budowa. Można powiedzieć, że to rodzaj zamykanej małej książeczki z czterema stronami o wymiarach podobnych do… paszportu (125 x 90 mm). Ten wymiar to z jednej strony wada, bo często trzeba się znacznie zbliżyć do wzorca, aby skutecznie z niego skorzystać, z drugiej jednak zmieści się niemal w każdej kieszeni, stąd zawsze można mieć go pod ręką. Dodatkowo dzięki takiej a nie innej budowie, nieużywany wzorzec może być zamknięty i zabezpieczony przede wszystkim przed ekspozycją na światło, co zdecydowanie może wydłużyć jego żywotność.

ColorChecker Passport Video zawiera cztery strony i każda z nich ma nieco inną funkcję:

- wzorzec skali szarości, który zawiera trzy pola – biel (90% IRE), średnią szarość (18% odbicia światła, 40 IRE) oraz czerń (ok. 0% IRE),

- wzorzec balansu bieli, dla ustawienia neutralnego i spójnego punktu bieli,

- wzorzec kolorów, zawierający 6 chromatycznych pól zaprojektowanych dla produkcji wideo, 6 pól z odcieniami skóry, 6 pól z balansem szarości oraz 6 pól dla świateł i cieni (w tym pole czerni o wysokim połysku) dla osiągnięcia idealnego balansu kolorystycznego),

- wzorzec ostrości, do pomocy przy ręcznym ustawianiu ostrości.

WZORZEC SKALI SZAROŚCI

Jedną z podstawowych cech dobrze zarejestrowanego materiału jest jego właściwa ekspozycja. Oczywiście można dyskutować co oznacza słowo “właściwa”, ponieważ nierzadko jest to decyzja kreatywna. Jednakże w większości przypadków oznacza ona odpowiednią jej wartość w odniesieniu do ludzkiej skóry, unikając jednocześnie obszarów zbyt ciemnych (niedoświetlonych) oraz zbyt jasnych (prześwietlonych). I tu z pomocą przychodzi właśnie wzorzec skali szarości oraz funkcje dostępne w kamerze, lub monitorze podglądowym takie jak Waveform, Zebra czy False Colors. Co również istotne, poziomy odniesienia właściwej ekspozycji dla poszczególnych pól (biel, średnia szarość, czerń) różnią się w zależności od zastosowanej gammy. Dla przykładu:

- dla gammy 2.4 (Rec 709), 90% biel powinna utrzymywać się na poziomie ok. 90 IRE, szarość na poziomie ok. 40 IRE, a czerń minimalnie powyżej 0 IRE,

- z kolei dla Slog3 (S-Gamut3.Cine) sugerowana wartość bieli to ok. 61%, średniej szarości ok. 41%, a czerni również minimalnie powyżej 0 IRE (więcej tutaj). Dodatkowo, jeśli chcemy skorzystać z metody ETTR, musimy wartość średniej szarości również odpowiednio podnieść (więcej o ekspozycji i ETTR tutaj).

I jeszcze jedna uwaga dotycząca korzystania z wzorca; ustawiamy go w miejscu, w którym oddziałuje na niego to samo oświetlenie, które pada na aktorów (bądź przedmioty będące w centrum uwagi), najlepiej w pobliżu twarzy.

Właściwa ekspozycja jest również niesłychanie ważna z punktu widzenia postprodukcji, ponieważ daje dużo więcej kreatywnych możliwości podniesienia “cieni”, czy obniżenia “jasności” (oczywiście w zależności od możliwości rozpiętości tonalnej kamery), zamiast np. wklejania nowego nieba w miejsce prześwietlonego i wizualnie nieciekawego. Dodatkowo odpowiednia wartość ekspozycji średniej szarości, która jest bardzo zbliżona do wartości właściwej dla odcieni skóry, pozwala na uniknięcie ewentualnych problemów przy stosowaniu color gradingu typu “teal & orange”, bądź LUT-ów opartych na tym zamyśle, gdyż zmieniają one dosyć mocno kolory powyżej i poniżej tej wartości, pozostawiając odcienie skóry jako neutralne.

WZORZEC BALANSU BIELI

Tak jak obraz niedoświetlony lub prześwietlony jest na etapie postprodukcji nie do odzyskania, tak ewentualnie zły balans bieli można wyrównać. Natomiast, aby nie tracić na to czasu, warto zadbać o jego właściwe ustawienie już na planie. Dobrą praktyką, nawet w sytuacji kontrolowanej w której znamy wartość temperatury barwowej, jest skorzystanie z odpowiedniej funkcji kamery, która odczytuje konkretną wartość zmierzoną na karcie wzorca, a nie tylko ręczne wpisanie tej wartości. Ma to również znaczenie w przypadku realizacji wielokamerowej, ponieważ nawet między tymi samymi matrycami przy tej samej wartości temperatury występują odchylenia. Z kolei w sytuacji tzw. “run and gun”, kiedy warunki nie są do końca kontrolowane i dynamicznie się zmieniają, można zmierzyć te wartości w odpowiednich miejscach (np. wewnątrz przy oświetleniu mieszanym i na zewnątrz przy naturalnym), zapisać w pamięci kamery, a następnie szybko zmieniać w zależności od potrzeby. Wówczas można szczególnie docenić kieszonkowe wymiary wersji Passport, dzięki którym wzorzec zawsze może być pod ręką. Zawsze warto jest również zarejestrować nawet kilku sekund obrazu z wzorcem do ewentualnego wykorzystania w trakcie postprodukcji.

Ktoś powie, że przecież teoretycznie można ustawić balans bieli na białej kartce, jednak to nie takie proste. Biała kartka może nam się wydawać biała, ponieważ tak działa ludzki mózg, podpowiadając niejako, że musi ona być biała. W rzeczywistości często zawiera ona delikatne przebarwienia, więc odczyt nie jest już dokładny. Produkcja prawdziwie neutralnej karty do balansu bieli jest wymagającym procesem technologicznym, ale za to gwarantującym pewne efekty. Dzięki niej jednak możemy zagwarantować sobie podstawę do idealnego odwzorowania kolorów, kiedy jest to szczególnie istotne, lub przynajmniej dobry neutralny punkt startowy, kiedy chcemy uzyskać look bardziej wyimaginowany.

KARTA Z WZORCAMI KOLORÓW

Ta karta zawiera poniekąd trzy rodzaje pól:

- 6 pól z balansem szarości oraz 6 pól dla świateł i cieni (w tym pole czerni o wysokim połysku), które w postprodukcji pomogą jeszcze dokładniej dopasować krzywą kontrastu pomiędzy różnymi kamerami,

- 6 pól z odcieniami skóry, które pozwolą sprawdzić dopasowanie do jednego z typowych odcieni koloru skóry,

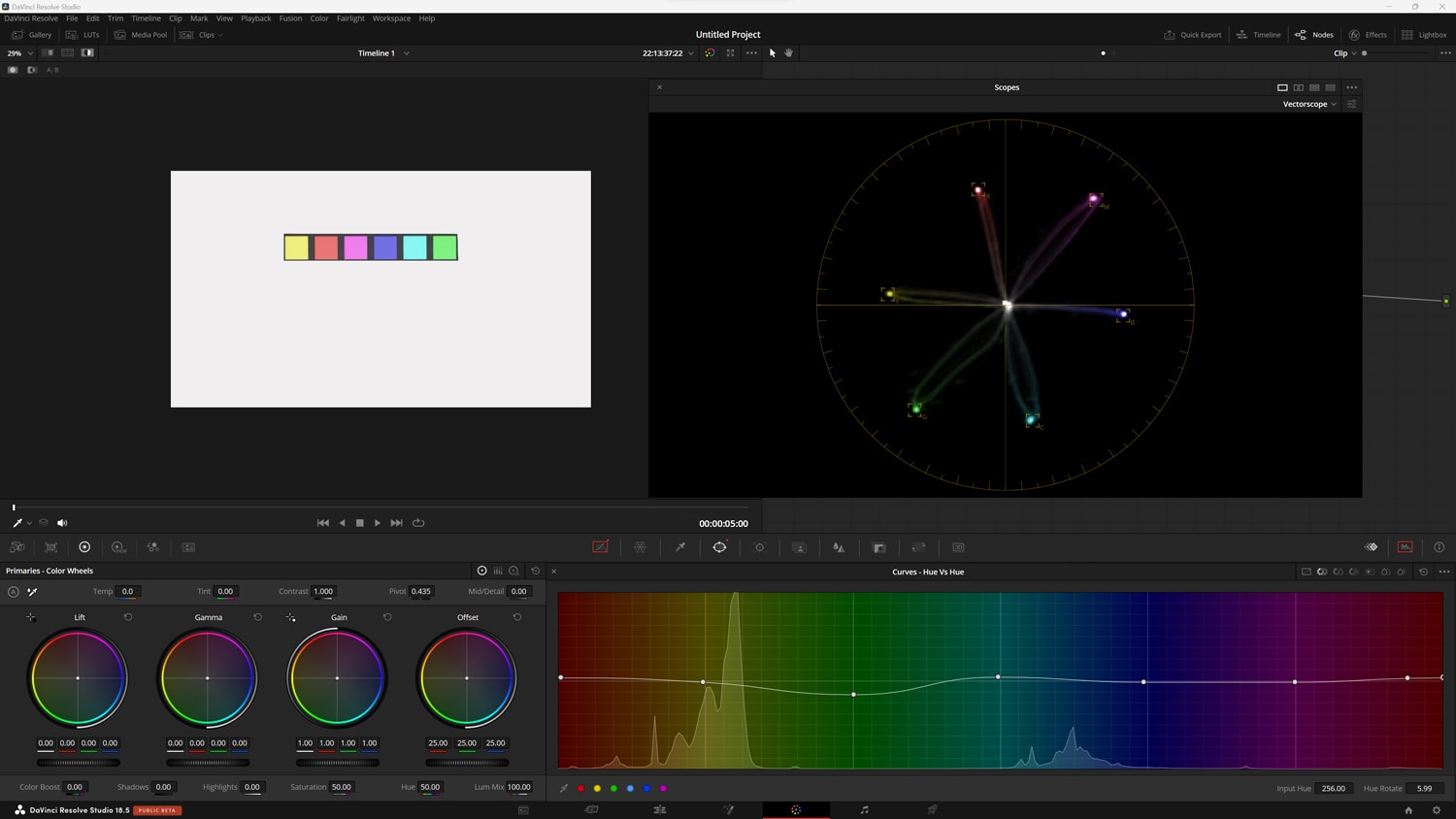

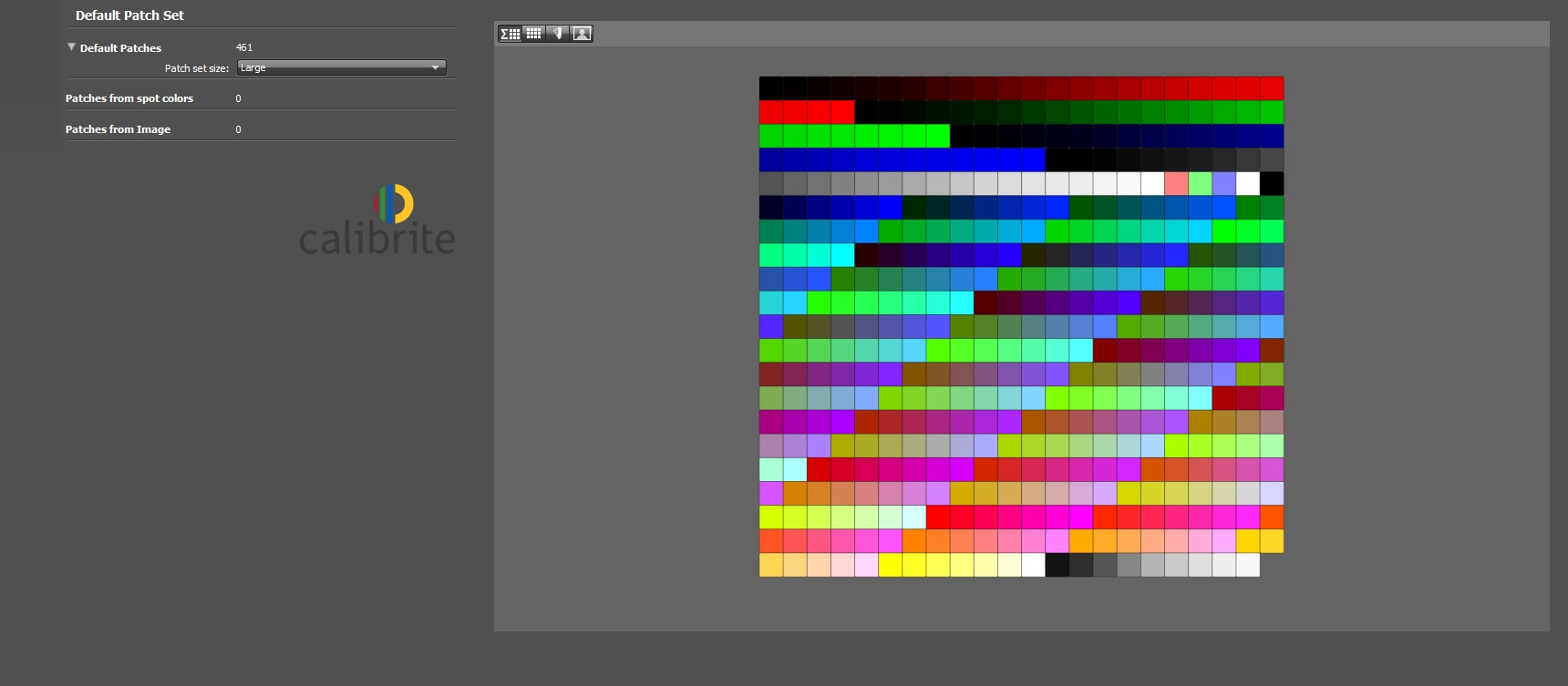

- oraz chyba najważniejsze – 6 chromatycznych pól zaprojektowanych dla produkcji wideo (różnią się one od tych stosowanych w fotografii). Dzięki rejestracji obrazu z wzorcem możemy zapewnić sobie nie tylko jeszcze dokładniejsze odwzorowanie kolorów (balans bieli odpowiada tylko, albo aż za temperaturę barwową oraz tintę, natomiast tutaj mamy kontrolę nad każdym z sześciu kolorów, tj. ich odcieniem i saturacją), ale również doskonałe dopasowanie obrazu z różnych kamer. W programach do postprodukcji wideo, np. DaVinci Resolve, są gotowe narzędzia do automatycznego dopasowania przy wykorzystaniu nagrania z wzorcem, ale jeszcze lepsze i bardziej dokładne efekty daje ręczne dopasowanie przy wykorzystaniu maski izolującej obszar pól, wykresu Vectorscope oraz korekty krzywych wpływających na zmianę odcienia (Hue Vs Hue) i saturacji (Hue Vs Sat) danego koloru.

Poniżej z kolei szczegółowy tutorial Ollie Kenchingtona, który m. in. również prezentuje korektę kolorów przy wykorzystaniu ColorCheckera w DaVinci Resolve:

KARTA OSTROŚCI

Karta ostrości, jak sama nazwa mówi, zdecydowanie ułatwia proces ręcznego ostrzenia, zwłaszcza w połączeniu z funkcją Peaking na wyświetlaczu lub monitorze podglądowym.

COLORCHECKER PASSPORT DUO

Jak wcześniej wspomniano, wzorce ze względu na różnice w referencyjnych kolorach dla fotografii i filmu do niedawna były dostępne jedynie w odrębnych wersjach. Na szczęście od niedawna można się zaopatrzyć w wersję Passport Duo, która kosztem utraty wzorca ostrości proponuje wzorzec kolorów dla fotografii stając się połączeniem obu. Po więcej szczegółów odsyłam do strony Calibrite, wzorzec jest dostępny np. tutaj w zaprzyjaźnionym sklepie wzorniki.eu.

TARGET HOLDER I PODSUMOWANIE

Niedawno pojawił się jeszcze jeden gadżet – uchwyt do wzorców pozwalający na wygodne wykorzystanie statywów do podtrzymywania wzorca, dzięki czemu można uniknąć ryzyka dotykania palcami pól wzorca podczas rejestracji próbki. Holder jest obecnie dodawany gratis przy zakupie wybranych wzorców. Przechodząc płynnie do podsumowania; ColorChecker Passport Video, choć wygląda trochę jak gadżet, jest niezwykle cennym elementem wykorzystywanym podczas zdjęć, jak i postprodukcji. Choć nie kosztuje przysłowiowych kilku złotych i nie jest wieczny, ze względu na swoje wykonanie zapewni nie tylko dokładność odczytu i reprodukcji kolorów, czy właściwą ekspozycję, ale też właściwie używany może posłużyć przez wiele lat, dopóki użyty pigment nie ulegnie degradacji. Warto śledzić stronę Calibrite, ponieważ w ciągu roku nie raz pojawiają się promocje, dzięki którym można sporo zaoszczędzić.

Poradnik DaVinci Resolve #3

Na koniec 2022 roku Blackmagic Design najpierw zafundował nam dosyć istotny update DaVinci Resolve do wersji 18.1, a następnie udostępnił program w wersji na iPad’a. Tymczasem mamy już luty, najwyższy więc czas nadrobić zaległości i zaprosić na kolejną porcję porad z serii “Quick Tip”!

JAK SZYBKO I ŁATWO POPRAWIĆ JAKOŚĆ DŹWIĘKU?

Na jakość dźwięku ma wpływ oczywiście wiele czynników, o których można rozprawiać godzinami, skupmy się zatem przynajmniej na kilku powiązanych bezpośrednio z DaVinci Resolve. A więc po pierwsze na planie zdecydowanie warto nagrywać dźwięk również na zewnętrznym rekorderze, takim jak chociażby Zoom H6, ponieważ tzw. preampy na tego typu dedykowanych urządzeniach z miejsca pozwalają na uzyskanie dużo lepszych rezultatów, niż w porównaniu do zdecydowanej większości kamer. Jednak ze względu na obawy związane z potrzebą późniejszej synchronizacji dźwięku, część twórców z tego rezygnuje. Tymczasem w DaVinci Resolve jest to banalne – w zakładce Media zaznaczamy oba pliki, tj. klip video oraz ścieżkę audio z rekordera i prawym przyciskiem myszy otwieramy menu, a następnie wybieramy sposób synchronizacji w opcjach Auto Sync Audio. Od tej pory ścieżka video tego klipu jest powiązana ze ścieżką audio z rekordera.

Z kolei na etapie postprodukcji wiele można zdziałać “ręcznie”, choćby za pomocą Equalizera czy, o czym traktował jeden z poprzednich wpisów, ręcznego usuwania elementów na poziomie sampli. Jednak często okazuje się, że zastosowanie odpowiednich wtyczek nie dość że zaoszczędzi masę czasu, ale może również pozwolić na osiągnięcie naprawdę świetnych efektów. W niedawno opublikowanej wersji 18.1 pojawiły się dwa nowe wbudowane efekty, tj. Dialogue Leveller i Voice Isolation (ten drugi zdaje się jest dostępny tylko w wersji Studio). Trzeba przyznać, że zwłaszcza Voice Isolation robi świetną robotę związaną z usuwaniem niechcianego szumu, z kolei Leveller, zwłaszcza przy krótszych wypowiedziach jednej osoby również potrafi oszczędzić sporo czasu. Z pewnością oba będą rozwijane przez twórców i kolejne wersje przyniosą jeszcze lepsze efekty. Wreszcie, warto rozważyć jeszcze dwie zewnętrzne wtyczki:

- Waves Clarity Vx, która podobnie jak Voice Isolation usuwa wszystko to, co wydaje się nie być ludzkim głosem (działa naprawdę fantastycznie, cena ok. 140 zł),

- oraz Izotope RX10 Elements, okrojona, ale i sporo tańsza wersja pełnego programu, zawierająca poza odszumianiem m. in. usuwanie pogłosu, trzasków, czy minimalizowanie efektu przesterów, (obecnie można ją znaleźć w cenie poniżej 500 zł).

Na koniec jeszcze jedna uwaga; tego rodzaju wtyczki potrafią dość mocno obciążyć komputer, więc warto pamiętać o opcji “Bounce” (w Fairlight menu u góry -> Timeline), dzięki czemu można wyrenderować efekty pracy na nową ścieżkę, a następnie pracować już tylko z resztą plików.

SKALOWANIE PRZESTRZENI ROBOCZEJ W SYSTEMIE WINDOWS

Wielu użytkowników Windowsa na to czekało! Jeśli komuś zatem umknęło uwadze, to ostatni update DaVinci Resolve 18.1.1 wprowadził możliwość ręcznego ustawienia skalowania przestrzeni roboczej. Jak to zrobić? W górnym menu: DaVinci Resolve -> Preferences, następnie w nowo otwartym oknie w zakładce User -> UI Settings -> UI Display Scale pojawia się opcja: Auto, 100%, 150% lub 200%. Mała rzecz, a cieszy!

EDYCJA PIONOWYCH KLIPÓW NA SOCIAL MEDIA

Czy to lubimy czy nie, ilość filmów w trybie pionowym ze względu na ich zastosowanie w mediach społecznościowych ciągle rośnie. Jak zatem ułatwić sobie montaż takich materiałów w DaVinci Resolve?

Przede wszystkim należy właściwie ustawić rozdzielczość Timeline; co prawda w Project Settings -> Master Settings -> Timeline Format -> Timeline Resolution już wcześniej można było wybrać Custom i podać własną rozdzielczość, ale od wersji 18.1.2 są gotowe presety (należy zaznaczyć Use vertical resolution). Warto również wiedzieć, że po kliknięciu ikony trzech kropek w prawym górnym rogu, można zapisać te ustawienia jako Save Current Setting as Preset lub …Default Preset!

Zmienić rozdzielczość Timeline można również:

- w zakładce Cut – klikając ikonę Timeline Resolution w prawym górnym rogu,

- w zakładce Media lub w zakładce Edit -> Media Pool – klikając prawym przyciskiem myszy na pliku Timeline, a następnie Timelines -> Timeline Settings i odznaczając na dole Use Project Settings. Dodatkowo w opcji Mismatched Resolution można zaznaczyć Scale full frame with crop, aby program automatycznie wypełnił całą przestrzeń, jednocześnie ucinając boki.

Po ustawieniu rozdzielczości, w przypadku klipów nagranych klasycznie bardzo przydatną opcją może być Smart Reframe (pojawiła się chyba już w wersji 17), dostępna w zakładce Edit -> Inspector, ale tylko w wersji Studio. Są tam do wyboru dwie opcje; pierwsza Auto, w której to program (Neural Engine) decyduje automatycznie o tym, co powinno się znajdować w centrum pionowego kadru, oraz druga – Reference Point, gdzie ten ważny dla montażu obszar można wskazać ręcznie. Najlepiej chyba zacząć od Auto, a następnie dokonywać poprawek z Reference Point.

PŁYNNY PODGLĄD DZIĘKI BLACKMAGIC PROXY GENERATOR

Płynny podgląd w trakcie edycji plików uzależniony jest od wielu czynników, m. in. takich jak możliwości procesora i karty graficznej, wielkości i rodzaju plików (zwłaszcza ze względu na sposób kompresji), czy ilości dokonywanych zmian w trakcie post-produkcji. Żeby zapobiec tnącemu się obrazowi nie zawsze trzeba od razu inwestować w droższy sprzęt lub ograniczać swoje kreatywne pomysły. Dobrym rozwiązaniem (jeśli to oczywiście możliwe) może być na przykład zmiana kodeka plików podczas rejestracji obrazu z tzw. Long GOP na All-Intra (w Sony może być to XAVC SI), lub już w samym DaVinci Resolve używanie Render Cache, Opimized Media czy wreszcie Proxy Files. Od wersji 18 tworzenie i używanie plików proxy dzięki aplikacji Blackmagic Proxy Generator stało się jeszcze bardziej proste i intuicyjne.

Wspomniana aplikacja jest częścią pakietu instalacyjnego, więc wystarczy ją odnaleźć i uruchomić. Za pierwszym razem należy od razu zdefiniować tzw. Watch Folder, czyli folder, w których program będzie szukał oryginalnych plików i w którym po przeprocesowaniu umieści sporo mniejsze pliki proxy zgrupowane w osobnym podfolderze Proxy. Tych Watch Folders może być wiele, a zarządzać nimi można poprzez przyciski poniżej: Add, Remove i Show. Dodatkowe dwie opcje to Delete Proxies i Extract Proxies. Poza wspomnianymi możemy jeszcze wybrać jedną z opcji formatu plików (Proxy Format) oraz powyżej ręcznie uruchomić procesowanie plików. Co ważne, przy aktywnej opcji procesowania (Start) po każdorazowym dodaniu kolejnych plików program automatycznie będzie tworzył pliki proxy.

Z kolei w samym DaVinci Resolve przełączanie się pomiędzy plikami oryginalnymi a proxy jest niezwykle proste. Otóż w menu Playback -> Proxy Handling ustawiamy odpowiednią opcję; Prefer Proxies, Prefer Camera Originals lub Disable All Proxies. Dodatkowo pliki proxy na Timeline są oznaczone małą ikoną (kamera z taśmą filmową), która znajduje się tuż obok nazwy pliku.

Poradnik DaVinci Resolve #2

Ponieważ minęło już trochę czasu od pierwszego wpisu z poradami dotyczącymi DaVinci Resolve, a w międzyczasie pojawiła się już nawet kolejna osiemnasta odsłona programu, najwyższy czas opublikować część drugą. Zapraszam zatem do lektury!

"MOC" FOLDERÓW POWER BINS I GRADES W PRAKTYCE

Power Bins i Power Grades to jedne z tych opcji DaVinci Resolve, które na co dzień bardzo ułatwiają życie zarówno montażystom, jak i kolorystom. Do czego służą i jak ich używać?

Najpierw Power Bins, czyli możliwość utworzenia specjalnego folderu w Media Pool, który będzie współdzielony w każdym projekcie w ramach danej bazy danych. Ta opcja standardowo jest ukryta, ale wystarczy z górnego menu wybrać View -> Show Power Bins, a w lewym menu Media Pool pojawi się sekcja Power Bins z głównym folderem Master. Oczywiście wewnątrz Power Bins można tworzyć własną strukturę folderów i nazywać je według swoich preferencji. To znakomita opcja dla wszystkich elementów używanych często w projektach, jak np. klipy intro, outro, sekwencje napisów czy Adjustment Clips, które dzięki Power Bins mogą być zawsze “pod ręką” gotowe do użycia.

Sekcja Power Bins jest dostępna wszędzie tam, gdzie Media Pool, z kolei Power Grades jest zarezerwowana tylko dla zakładki Color. Po lewej stronie u góry znajduje się ikonka Gallery, a po kliknięciu w nią poniżej pojawiają się dwie mniejsze ikonki. Ta z lewej, Still Albums, uruchamia dodatkowe menu m. in. z albumem PowerGrade1. I znów najważniejsze – ten album jest współdzielony we wszystkich projektach w ramach danej bazy danych. Klikając prawym przyciskiem można dodać kolejne albumy, zmieniać ich nazwy, czy przeciągając „Stills” przenosić je między albumami. Power Grades co oczywiste, to znakomita opcja do szybkiego przenoszenia korekcji kolorystycznych z innych klipów, ale nie tylko. Koloryści często korzystają z tzw. Fixed Node Tree, nanosząc na nowy klip swoją stałą strukturę Node’ów wraz z ich opisami, ale bez żadnych korekcji. Powszechne jest również stosowanie gotowych Node’ów, lub ich grup, służących do konkretnych zadań, jak np. Color Space Transform w przypadku ręcznego zarządzania kolorem.

USUWANIE TRZASKÓW ZE ŚCIEŻEK W FAIRLIGHT

Badania pokazują, że człowiek ma dużo większą tolerancję na gorszy obraz, niż dźwięk, dlatego trzeba o niego szczególnie zadbać. Oczywiście to bardzo szeroki temat, ale tym razem zajmę się jednym konkretnym problemem, a mianowicie usuwaniem wszelkiego rodzaju “trzasków”. Każdy, kto zajmuje się edycją materiałów filmowych, zwłaszcza wywiadów, wcześniej czy później zmierzy się z takim, który zawierać będzie pojawiające się w tle bardzo krótkie, ale rozpraszające i zdecydowanie niepożądane dźwięki. Jak to naprawić?

W DaVinci Resolve w zakładce Edit najmniejszą jednostką jest jedna klatka, ale to wciąż relatywnie długi odstęp czasu i wprowadzanie zmian dotyczących nawet jednej klatki będzie zauważalne. Na szczęście w zakładce Fairlight można ścieżkę dźwiękową powiększać aż do poziomu tzw. sampli, których w czasie trwania jednej klatki jest wiele, a następnie w bardzo łatwy sposób je edytować. Otóż klikając i przytrzymując wciśnięty lewy przycisk myszy można przesuwać kursor w prawo/lewo zmieniając ich pozycję, czyli poziom głośności. Oczywiście jeśli ścieżka jest stereo, to identyczną operację należy powtórzyć na drugim kanale. “Trzaski” mają to do siebie, że są głośne, ale za to bardzo krótkotrwałe, więc ta metoda świetnie się tu sprawdza.

DO CZEGO SŁUŻY KARTA BLACKMAGIC DESIGN DECKLINK?

Temat, który nie dotyczy tylko i wyłącznie DaVinci Resolve, ale Blackmagic Design ogłosił niedawno wypuszczenie na rynek nowych modeli – DeckLink Mini Monitor HD i DeckLink Mini Recorder HD i z tej okazji może warto wyjaśnić do czego one służą i dla kogo zakup jednej z nich może być zdecydowanie dobrym pomysłem.

A więc krótko mówiąc Decklink to seria kart PCI Express do odtwarzania lub przechwytywania obrazu, a poszczególne modele różnią się od siebie ilościami i rodzajami złącz, ich funkcją oraz specyfikacją sygnału, w tym rozdzielczością. Możliwości jakie daje taka karta powinny zainteresować przede wszystkim użytkowników zakładki Color. Nie od dziś wiadomo, że zarówno Windows, jak i macOS z lepszym lub gorszym skutkiem radzą sobie z zarządzaniem colorem wyświetlanego obrazu, z kolei kolorystom zależy na tym, aby pracować na obrazie jak najbardziej “czystym”. I tu z pomocą przychodzi karta Decklink, np. DeckLink Mini Monitor 4K, która zapewnia wyjście sygnału bezpośrednio z DaVinci Resolve prosto do monitora, a z pominięciem wpływu wspomnianych systemów operacyjnych. Do kart dedykowane jest również oprogramowanie na którym można dokonywać stosownych ustawień, innych z kolei dokonuje się już w DaVinci Resolve: Project Settings -> Master Settings -> Video Monitoring.

Warto również wspomnieć, że przy ograniczonym budżecie, przy pomocy darmowego oprogramowania DisplayCAL, wspomnianej karty, kalibratora oraz przynajmniej podstawowej wiedzy na temat, można samemu skalibrować monitor do możliwie najdokładniejszej pracy z kolorem w DaVinci Resolve, choć oczywiście usługi wyspecjalizowanych w tym zakresie firm zewnętrznych pozwalają uzyskać jeszcze bardziej dokładne efekty.

KILKA NIEZWYKLE PRZYDATNYCH OPCJI W TEXT+

Aby do klipu video dodać prosty tytuł czy napis w oknie Edit można z zakładki Effects użyć Text, ale to Text+ daje dużo większe możliwości zabawy. A zatem po wrzuceniu go na Timeline klikamy prawym przyciskiem myszy -> Open in Fusion Page i przechodzimy do Fusion. Oto kilka niezwykle przydatnych opcji, które są tam dostępne:

- Po prawej stronie w oknie Inspector i zakładce Tools mamy oczywiście pole wprowadzania tekstu oraz różnego rodzaju inne opcje, dotyczące m. in. możliwości zmieniania czcionki, koloru, rozmiaru, pozycji, dodawania obramowania czy cienia, wszystkie one jednak wpływają na tekst jako całość. Natomiast klikając prawym przyciskiem myszy we wspomnianym polu wprowadzania pojawia się nowe okienko z różnymi funkcjami, a wśród nich Character Level Styling. Otóż dzięki niej, w nowej zakładce Modifiers (obok Tools) można z osobna zmieniać charakter pojedynczych liter bądź części tekstu, oczywiście po uprzednim ich zaznaczeniu w oknie podglądu.

- Inną z ciekawych opcji, w jakimś sensie podobną do poprzedniej jest Follower, która z kolei umożliwia zróżnicowanie zastosowanej animacji tekstu, np. zmianę pozycji czy zanikanie, w ten sposób, że animowany jest również nie cały tekst na raz, ale poszczególne litery jedna po drugiej, w sposób uporządkowany lub przypadkowy, oraz z odpowiednim opóźnieniem, według ustawień z zakładki Modifiers -> Timing.

- Kolejną przydatną funkcją, zwłaszcza przy różnego rodzaju bardziej złożonych napisach, jest możliwość zastosowania tabulatorów; wystarczy w polu wprowadzania tekstu przed daną sekcją wcisnąć Tab, a następnie wygodnie sterować pozycją i wyrównaniem danego tabulatora czy to z okna podglądu, czy z zakładki Tab Spacing.

- I wreszcie można wywołać wspomniane wyżej okienko z funkcjami nie tylko w polu wprowadzania tekstu, ale również w pobliżu innych wartości w okienku Inspector, a na samym dole pojawi się Expression (można ją również wywołać wpisując w polu wartości znak „=”). To może niepozorna opcja, ale dająca przeogromne możliwości. Otóż po „=” można podać odpowiednią funkcję (np. time oznacza numer klatki kompozycji) lub klikając na mały plusik poniżej i przeciągając myszką połączyć z innym polem wprowadzania wartości (np. kiedy połączymy oś X z Y, zmieniając wartości na osi X, automatycznie są one zmieniane również na osi Y). Expressions to temat o niezwykle wielkim potencjale na osobną dyskusję, warto o tym poczytać choćby w manualu DaVinci Resolve.

Kalibracja systemowa dowolnego monitora

Dobrze skalibrowany monitor to nieodzowny element świadomego procesu post-produkcji graficznej, fotograficznej czy filmowej, a jednak wciąż przez tak wielu twórców ignorowany. Jeśli można zrozumieć, że po stronie klienta zarządzanie kolorem jest często kwestią osobistych subiektywnych preferencji, tak już profesjonaliści powinni być pewni efektów swojej pracy. Zdarza się, że wytłumaczeniem jest na przykład brak budżetu na drogi monitor. Tymczasem praktycznie każdy wyświetlacz, nawet ten w laptopie, co prawda tylko systemowo, ale da się skalibrować! Nieświadomych różnicy między kalibracją systemową i sprzętową odsyłam do osobnego wpisu na ten temat, tymczasem tutaj przybliżę proces kalibracji systemowej mojego laptopa Dell Vostro oraz monitora Benq PD2500Q, który również nie ma możliwości kalibracji sprzętowej.

CO JEST POTRZEBNE DO KALIBRACJI SYSTEMOWEJ?

Aby samemu skalibrować monitor, potrzebujemy przede wszystkim kalibrator wraz z oprogramowaniem oraz odrobinę wiedzy na temat. W tej pierwszej kwestii jak to zwykle bywa rozwiązań jest kilka, od takich za kilkaset złotych aż po… powiedzmy bardzo drogie. Z osobistych doświadczeń mogę jednak polecić sprzęt marki Calibrite (wcześniej X-Rite). Od ponad trzech lat używam modelu X-Rite I1 Display Pro (obecnie Calibrite Color Checker Display Pro), który jest dostępny za kwotę oscylującą koło tysiąca złotych. Z modeli podobnych jest jeszcze tańszy Calibrite Color Checker Display, ale on współpracuje tylko z oprogramowaniem Calibrite, oraz droższy Calibrite Color Checker Display Plus, dla wyświetlaczy powyżej 1000 nitów. Moim zdaniem warto wybrać przynajmniej model Pro, ponieważ w przypadku inwestycji w lepszy monitor, bądź też wykorzystania innych programów, jak np. DisplayCAL, w przeciwieństwie do niższego modelu ciągle będzie można z niego korzystać. Wspomniany kalibrator służy mi więc do kalibracji sprzętowej (np. przy wykorzystaniu oprogramowania Palette Master Element firmy BenQ) i systemowej, jak również do pomiaru np. równomierności podświetlenia matrycy czy luminancji otoczenia.

Kolejny element to oprogramowanie, które w przypadku Calibrite jest dostępne darmowo ze strony producenta (dla modelu Pro to ccProfiler). No i tym ostatnim elementem jest odrobina wiedzy, którą będę się starał poniżej dostarczyć.

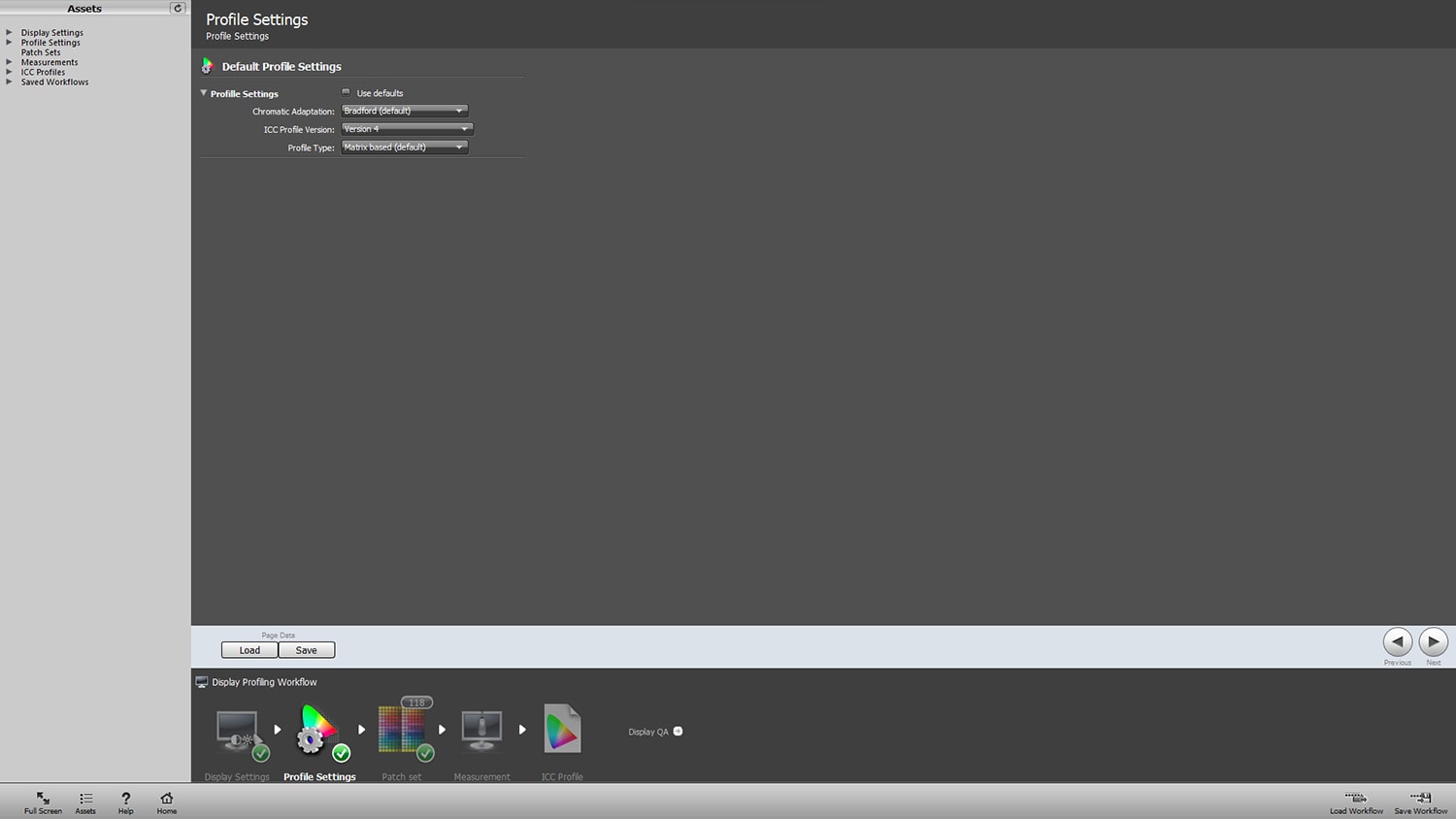

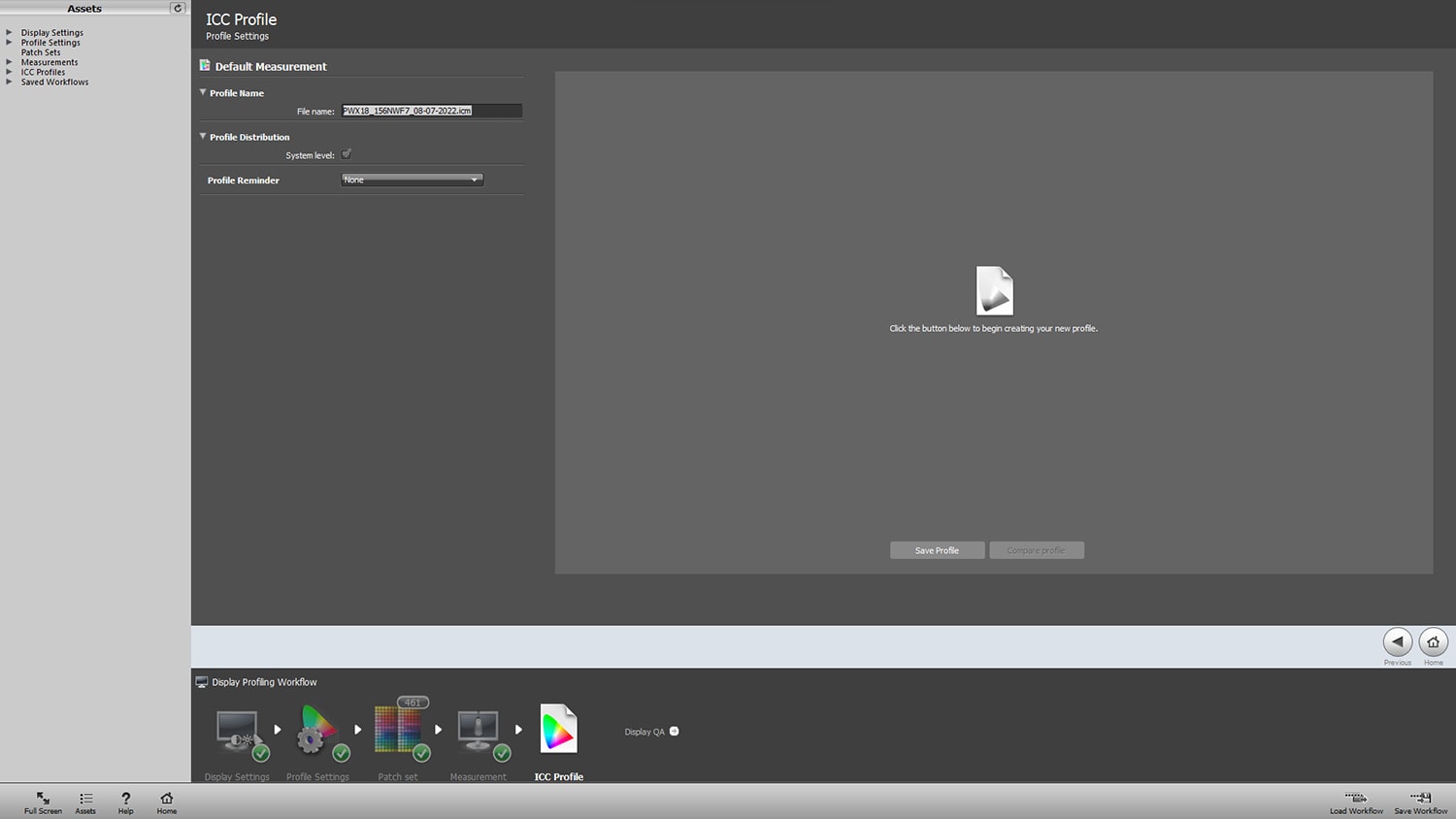

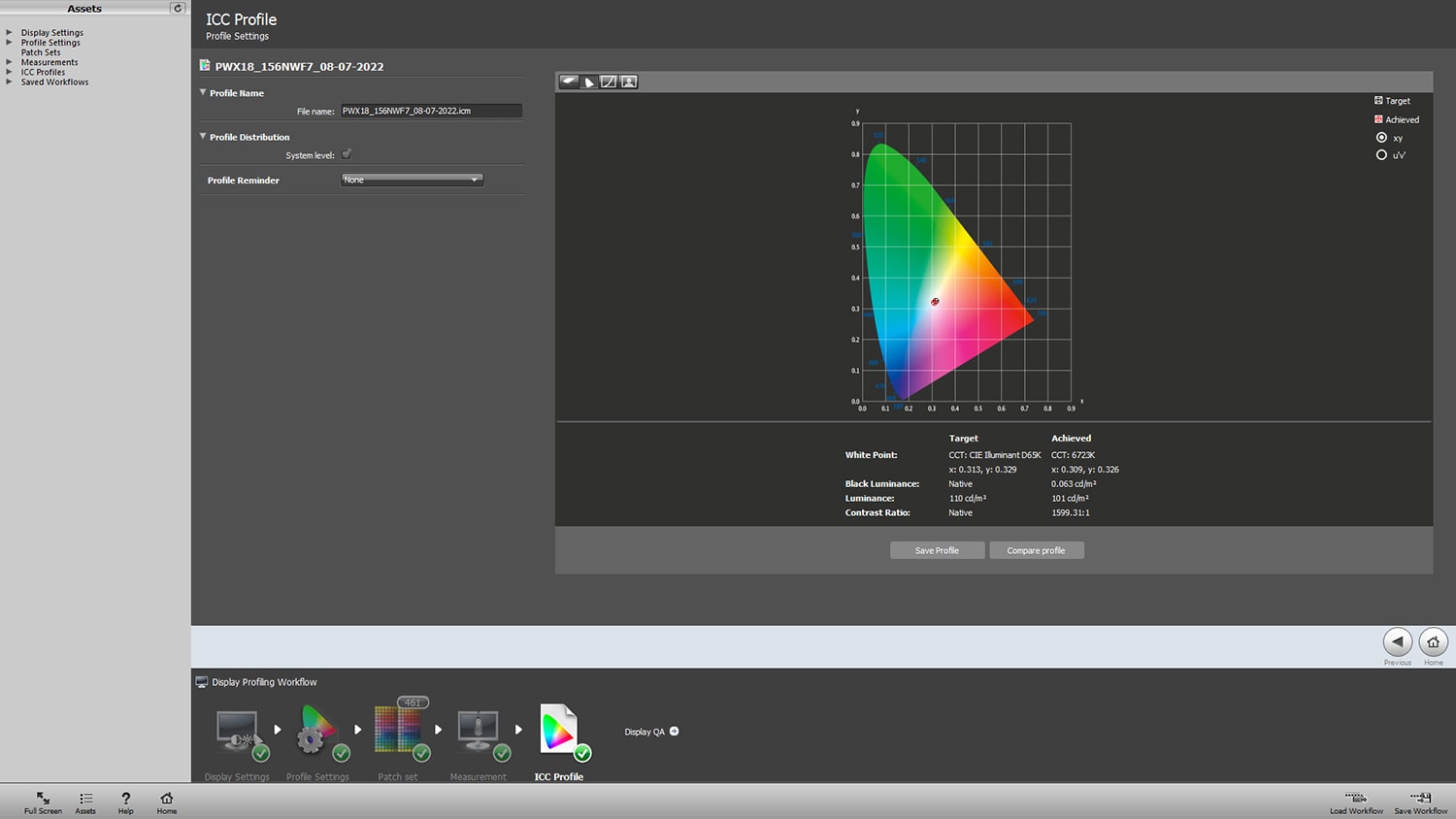

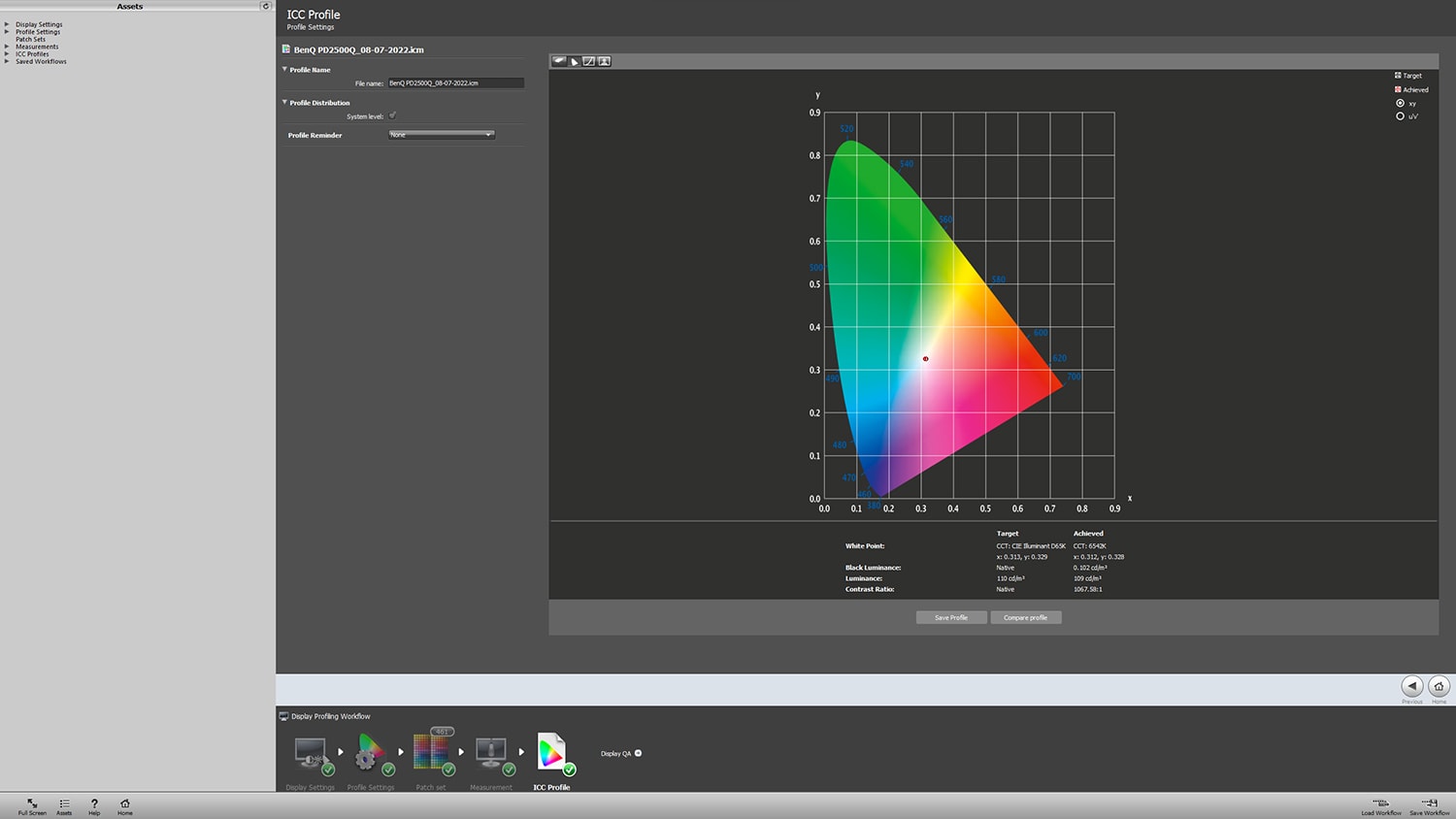

PRZEBIEG PROCESU KALIBRACJI

Po zainstalowaniu oprogramowania i podłączeniu kalibratora do komputera rozpoczynamy proces kalibracji (choć tak de facto powinno się powiedzieć profilowania monitora, ponieważ po zakończeniu, w odróżnieniu od kalibracji sprzętowej, uzyskamy tylko profil icc, jednak najczęściej zarówno sprzętową jak i systemową mimo wszystko określa się jako kalibrację, więc pozostanę przy tym nazewnictwie). Jak wspomniałem będę kalibrował wyświetlacz w swoim laptopie Dell Vostro oraz monitor BenQ PD2500Q, ponieważ proces z dwoma wyjątkami wygląda identycznie. A więc po odpaleniu ccProfilera na ekranie początkowym najpierw po prawej stronie wybieramy opcję Advanced, a następnie po lewej u góry Display -> Profilling.

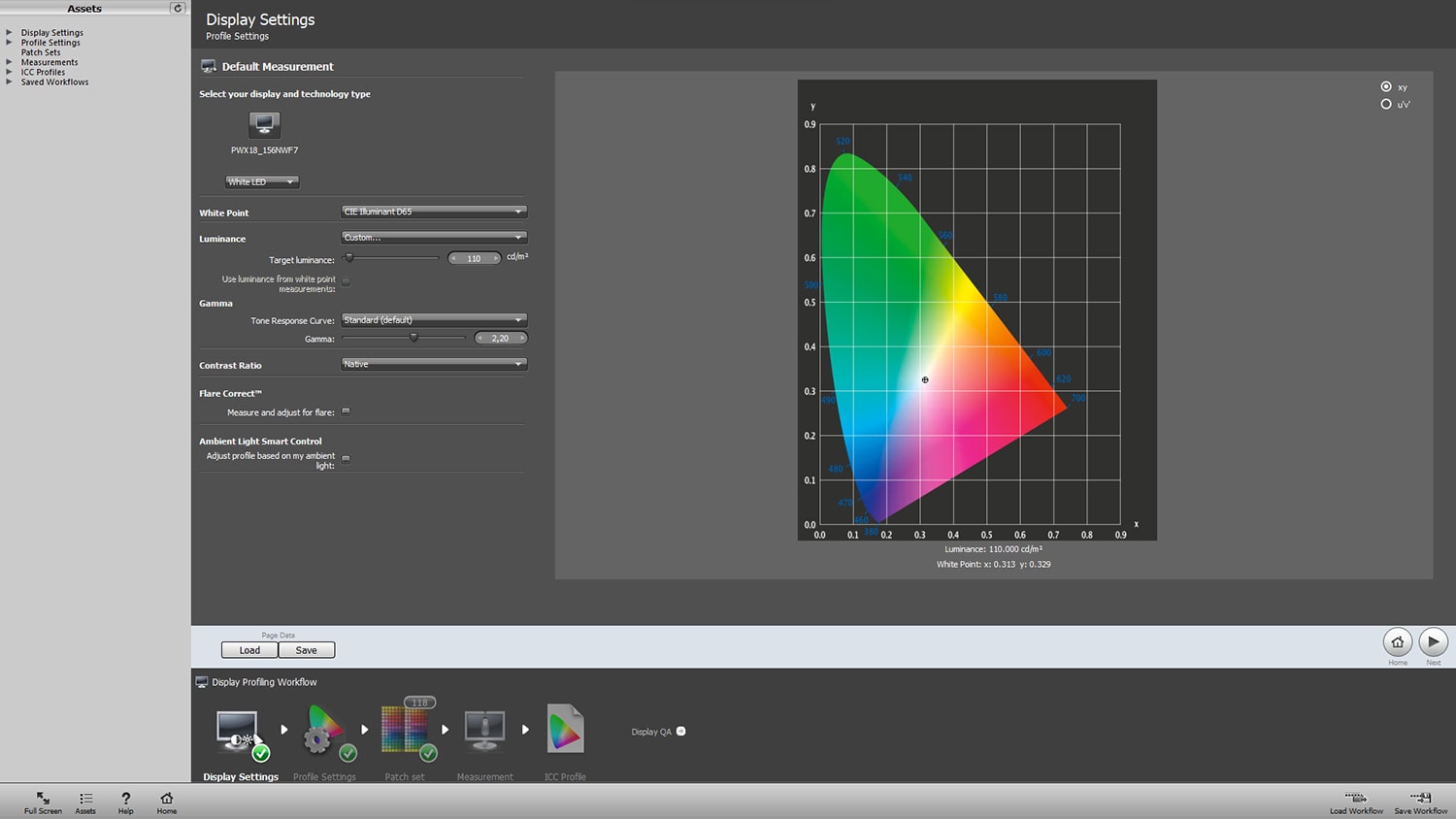

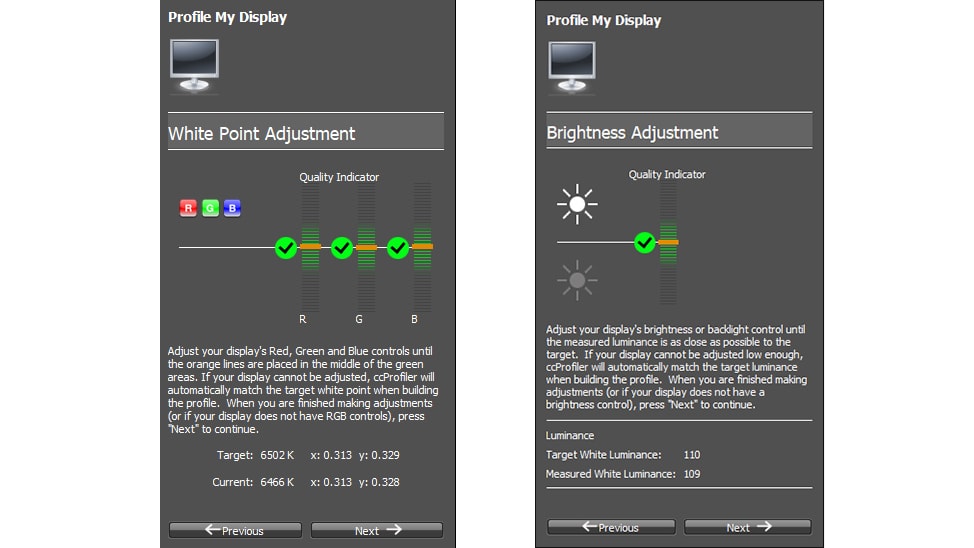

Na kolejnym ekranie dokonujemy w zasadzie najważniejszych ustawień:

- Typ wyświetlacza i punkt bieli (White Point) z reguły pozostawiamy na wartościach domyślnych.

- Luminancję (Luminance) wybieramy custom i podajemy konkretną wartość, z reguły dla treści publikowanych w internecie przyjmuje się 110-120 cd/m2, w przypadku druku 80-90 cd/m2, ja przyjmuję 110 cd/m2. Warto wspomnieć, że tą wartość można dokładnie zmierzyć za pomocą kalibratora. Osobnym tematem jest również zapewnienie odpowiednich warunków pracy, tj. przestrzeni raczej zacienionej i nie zmieniającej się względem nasłonecznienia, idealne byłyby również szare ściany nie wpływające na odbiór kolorów na obrazie.

- Gammę (Gamma) czyli krzywą przedstawiającą sposób interpretacji luminancji obrazu cyfrowego ustawiamy na 2.2 (inną opcją może być 2.4 – to gamma dla przestrzeni Rec709, typowej dla nieco ciemniejszego obrazu filmowego).

- Kontrast (Contrast Ratio) pozostawiamy na Native.

- Nie zaznaczamy również opcji Flare Correct oraz Ambient Light Smart Control, gdyż mogą one wpływać na niekontrolowaną zmianę sposobu wyświetlania obrazu w trakcie pracy.

Poniżej jest również opcja Load lub Save dla załadowania pliku z tymi ustawieniami, lub zapisania ich na później. Następnie klikamy Next.

Na następnym ekranie można dokonać ustawień dotyczących samego profilu, nie zagłębiając się w szczegóły proponuję wybrać opcję ICC Profile Version -> Version 4 i kliknąć Next.

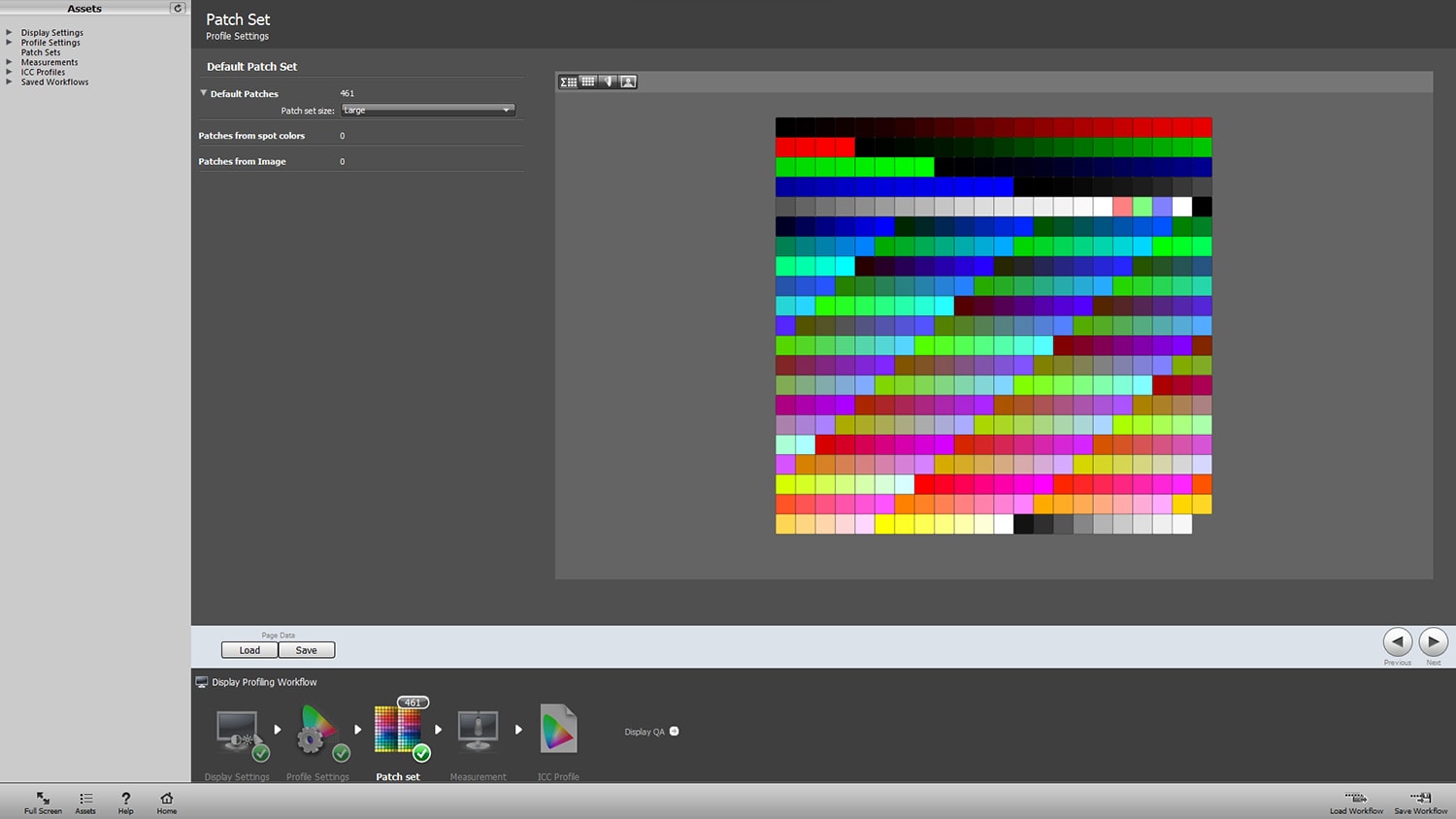

Tutaj z kolei możemy ustawić liczbę plansz, które będą wyświetlane podczas kalibracji, proponuję wybrać Large, dzięki czemu profil będzie dokładniejszy, a sam proces potrwa tylko 2-3 minuty dłużej.

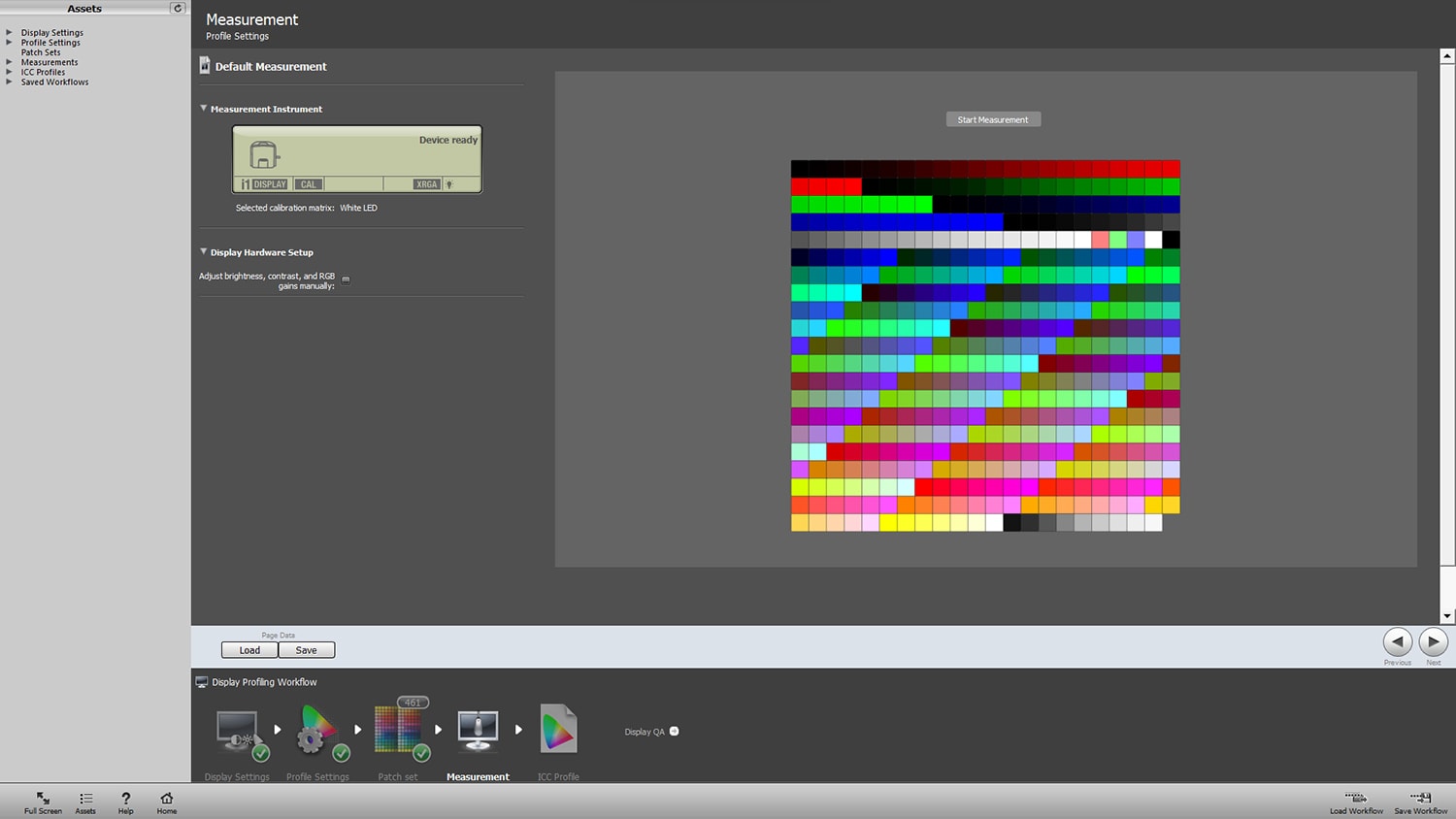

Kolejne ustawienia dotyczą możliwości ręcznej regulacji jasności oraz wartości RGB. W przypadku kalibracji wyświetlacza laptopa nie mam takiej możliwości, pozostawiam zatem to pole niezaznaczone. Jednak przy kalibracji monitora BenQ PD2500Q opcja ta powinna być zaznaczona.

W kolejnym kroku program prosi o ściągnięcie osłony z kalibratora i umieszczenie go mniej więcej na środku ekranu, istotne jest również takie jego ustawienie, aby idealnie spoczywał na powierzchni wyświetlacza. Wówczas rozpoczyna się właściwy proces, w trakcie którego kalibrator rejestruje dane z ekranu. W przypadku laptopa zobaczymy różne plansze, najpierw jasne i ciemne, a następnie w różnych kolorach aż do zakończenia procesu. Natomiast w przypadku monitora Benq PD2500Q, podczas pomiarów program wyświetli i jeśli to potrzebne – poprosi o ręczną zmianę w ustawieniach monitora zarówno wartości RGB (temperatura barwowa), jak i jasności.

Wreszcie na koniec pojawi się plansza z edytowalną proponowaną nazwą pliku oraz możliwością zaznaczenia Profile Distribution – System Level, dzięki czemu utworzony profil icc stanie się domyślnym. Klikamy Save Profile.

Profil został zapisany. Na ostatniej planszy widzimy uzyskane wyniki; poniżej dla wyświetlacza laptopa Dell Vostro oraz monitora BenQ PD2500U.

PROFILE ICC

Nie mam doświadczenia z komputerami macOS, ale w Windows warto wiedzieć, że istnieje zakładka Zarządzanie Kolorami, w której po wybraniu danego urządzenia i zaznaczeniu opcji “Użyj moich ustawień dla tego urządzenia” można zarządzać profilami, np. dodając i/lub usuwając je z listy profili skojarzonych z tym urządzeniem czy zmieniając profil domyślny (usunięcie profilu z listy nie usuwa go z komputera, trzeba to zrobić ręcznie o czym również w poprzednim wpisie). Z kolei używane w danej chwili profile można szybko zmieniać klikając prawym przyciskiem myszy na pulpicie i wybierając opcję „Ustawienia ekranu”, a następnie „Profil kolorów”.

PROMOCJA URODZINOWA CALIBRITE

Możecie mi wierzyć, bądź nie, ale właściwie w dzień planowanej publikacji tego wpisu ukazała się promocja na kalibratory z okazji rocznicy Calibrite (nie wdając się w szczegóły firma X-Rite została przejęta przez Calibrite i od roku sprzedaje produkty pod własną marką). Wspominałem, że polecany model Calibrite Colorchecker Display Pro standardowo kosztuje ok. tysiąca złotych, natomiast od dziś można go kupić za jedyne…. 839 zł! Promocja dotyczy również innych modeli, jest dostępna u wybranych dystrybutorów (np. tutaj*) i trwa do 19.07.2022.

(* Jest to link do zaprzyjaźnionego sklepu, który polecam i jednocześnie nie jest on linkiem afiliacyjnym.)

CZĘSTOTLIWOŚĆ KALIBRACJI

Kalibracja to nie jest proces jednorazowy, wyświetlacze zmieniają swoje właściwości i warto powiedzmy raz na pół roku, a już na pewno raz na rok ją przeprowadzić. Dla mnie posiadanie kalibratora to wygoda, bo mogę po niego sięgnąć w dowolnym momencie, oszczędność, bo przy kilku monitorach i różnych potrzebach zakup bardzo szybko się zwrócił, ale co najważniejsze pewność, że oddaję klientowi prace, które nie są zależne od przypadkowości ustawień mojego wyświetlacza.

PODSUMOWANIE

Opisany wyżej proces to to zdecydowanie duży krok naprzód dla osób, które wcześniej nie kalibrowały/profilowały swoich monitorów, trzeba jednak zdawać sobie sprawę z tego, że nie jest on również pozbawiony niedoskonałości. Natomiast patrząc w stronę bardziej profesjonalnej pracy z kolorem jedyna możliwość to monitory kalibrowane sprzętowo, ponieważ tego rodzaju kalibracja może zapewnić dużo dokładniejsze wyniki. Wreszcie dla osób, które same nie czują się pewnie w tym temacie zdecydowanie polecam skorzystanie z usług firm, które kalibracją zajmują się profesjonalnie, co dla twórców pracujących na potrzeby np. telewizji czy dużych reklamodawców jest standardem.

Produkcja transmisji online

Niesamowity rozwój technologii w ostatnich latach sprawił, że dziś pod hasłem transmisja online może kryć się zarówno nastolatek ze smartfonem w ręku, jak i wieloosobowa, doświadczona ekipa posługująca się niezwykle kosztownym sprzętem, a jedyne co ich łączy to dostęp do internetu. Ofercie Kaktus.studio zdecydowanie bliżej do tej drugiej opcji. Jak zatem wyglądają kulisy takich produkcji?

ZARZĄDZANIE TRANSMISJĄ POPRZEZ MIKSER ATEM MINI EXTREME

Prawdziwym sercem całego systemu jest mikser obrazu i dźwięku. Odkąd w 2019 roku firma Blackmagic Design wypuściła nowe produkty z serii Atem Mini, rynek zyskał zupełnie nowy segment, zarezerwowany wcześniej wyłącznie dla produkcji wysokobudżetowych. Z kolei kiedy w 2021 roku świat ujrzały modele Atem Mini Extreme, m. in. z funkcjami Supersource oraz dwoma wyjściami USB i HDMI, możliwości stały się już tak wielkie, że przy odpowiedniej jakości pozostałym osprzęcie, doświadczeniu ekipy i właściwym przygotowaniu do transmisji, ich jakość może być porównywalna do telewizyjnej!

W Kaktus.studio korzystamy właśnie z miksera Atem Mini Extreme. Jest to urządzenie, do którego można wprowadzić do ośmiu sygnałów wideo (i audio) oraz dodatkowo dwa osobne sygnały audio. Możemy zatem użyć np. pięciu kamer i trzech innych urządzeń, takich jak np. laptop czy tablet, przesyłających prezentacje, filmy czy grafiki oraz dwóch osobnych mikrofonów. Wspomniana funkcja Supersource pozwala na jednoczesną prezentację na ekranie dwóch lub więcej źródeł przy wykorzystaniu spersonalizowanych grafik jako tła, a całość może być dynamicznie zmieniana (animowana), co daje bardzo profesjonalny i estetyczny wygląd dla odbiorców.

Ponadto urządzenie pozwala na podłączenie dwóch monitorów, z czego jeden służy do podglądu wieloekranowego dla realizatora transmisji, a drugi skierowany jest w stronę osób prowadzących, mogą oni zatem podglądać przekazywany aktualnie obraz, lub np. pytania od widzów w trakcie sesji Q&A. Oczywiście cały przekaz jest rejestrowany na zewnętrzny dysk w oryginalnej rozdzielczości HD, więc materiał może być następnie poddany postprodukcji, lub od razu udostępniony na innych platformach. I jeszcze dwa słowa a propos platform; streaming może być prowadzony bezpośrednio z urządzenia na YouTube, Facebook, Vimeo, czy inne media udostępniające tzw. streaming key, lub poprzez połączenie USB z komputerem, kiedy to komputer jest urządzeniem nadającym sygnał, a Atem działa dla niego jako kamera internetowa.

KAMERY

Wspomniałem wyżej, że transmisja może być prowadzona z użyciem nawet ośmiu kamer, wszystko oczywiście zależy od budżetu i realnego zapotrzebowania. W Kaktus.studio pracujemy na dwóch własnych kamerach Sony a7sIII oraz Sony A7IV, gwarantujących identyczny obrazek oraz przy użyciu profilu S-Cinetone, pozwalającym uzyskać piękne i naturalne kolory. W przypadku potrzeby użycia większej ilości sprzętu posiłkujemy się rentalem. Dodatkowo dysponujemy statywami wideo marki Manfrotto, dzięki czemu ruch kamery jest płynny i przyjemny dla oka.

DŹWIĘK

Mówi się, że poziom tolerancji widza jest znacznie wyższy w przypadku obrazu, niż dźwięku, stąd też staramy się dbać o niego w najwyższym stopniu. Mamy zatem do dyspozycji przede wszystkim bezprzewodowe systemy z mikrofonami krawatowymi marki Sennheiser, będące standardem w wielu stacjach telewizyjnych i radiowych. Kolejne to mikrofony kierunkowe Sennheiser i Rode oraz rejestrator dźwięku i mikrofon Zoom H6. Dodatkowo, o czym nie wspominałem, samo urządzenie Atem Mini Extreme pozwala na użycie funkcji takich jak Equalizer z filtrem dolno- i górnoprzepustowym, Expander czy Limiter. Wszystko to sprawia, że dźwięk towarzyszący obrazowi będzie czysty i przyjemny dla ucha, a prowadzący nieograniczeni przestrzenią poruszania się po planie.

OŚWIETLENIE PLANU

Kolejnym ważnym elementem jest oświetlenie planu. Do naszej dyspozycji są dwie lampy marki Fomei o mocy 210W każda, wraz z softboxami o średnicy 120 cm oraz mniejsza lampa Aputure Amaran o mocy 60W również z softboxem. Lampy te dają bardzo równe pod kątem odwzorowania kolorów oświetlenie i mają zmienną temperaturę barwową, co umożliwia dopasowanie się do istniejących warunków na planie. Dodatkowo w razie potrzeby posiłkujemy się lampami zaprzyjaźnionego producenta – Glare One.

PREPRODUKCJA

Aby zapewnić późniejszy sukces wydarzenia, wspólnie z klientem przygotowujemy dokładny scenariusz wszystkich działań na antenie. Odpowiednio wcześniej umawiamy się też na wizytę na miejscu, aby sprawdzić możliwości ustawienia kamer i oświetlenia sceny, czy przetestować jakość połączenia internetowego.

W ofercie Kaktus.studio jest również możliwość zamówienia odpowiedniej oprawy graficznej, w tym klipów wideo na rozpoczęcie i zakończenie transmisji, dopasowanych do kolorystyki i logotypu używanego przez klienta.

PRODUKCJA TRANSMISJI ONLINE

W zależności od rodzaju i wielkości wydarzenia meldujemy się na miejscu albo w dzień poprzedzający, albo już w samym dniu transmisji, ale przynajmniej kilka godzin wcześniej, aby spokojnie przygotować się do realizacji. Proces rozkładania sprzętu, kabli, itd. (a zwłaszcza później składania) to zdecydowanie najmniej lubiana przez nas część całego procesu. Następnie wchodzimy na antenę, a doświadczenie i przygotowany plan działania pozwalają na pracę bez przykrych niespodzianek. A kiedy transmisja dobiega końca, zadowolone twarze uczestników mówią jedno: mamy to!

POSTPRODUKCJA

Z kolei po zakończeniu transmisji klienci często udostępniają zapis w mediach społecznościowych, który uprzednio może zostać poddany jeszcze korekcie w studio, jak również ewentualnie uzupełniony o dodatkowe elementy jak np. napisy dla niesłyszących czy tłumaczenia.

OPCJE DODATKOWE

Każdy klient, każdy wydarzenie to praktycznie inna konfiguracja i inne potrzeby. Warto zatem wiedzieć, że podczas transmisji można również wykorzystać dodatkowe możliwości, takie jak:

- zaproszenie gości uczestniczących w sposób zdalny (np. poprzez aplikacje typu Zoom),

- kluczowanie, tzw. green screen,

- prowadzenie równoległych transmisji, np. w j. polskim i angielskim (przy założeniu otrzymania sygnału z kabiny tłumacza),

- oraz inne ustalane indywidualnie.

Jeśli myślisz o przeprowadzeniu transmisji online, skontaktuj się po więcej informacji!

Co zawdzięczam fotografii

Ten wpis będzie nieco bardziej osobisty, a zarazem dużo mniej techniczny, niż pozostałe. Otóż kiedy założyłem Kaktus.studio poczułem, że wreszcie robię to, co kocham i to jest szczera prawda. Każdy dzień spędzony na filmowaniu i fotografowaniu przynosił mi niesamowitą frajdę, każde warsztaty nową wiedzę, a każdy zakończony projekt doświadczenie. Dziś mogę śmiało stwierdzić, że potrafię obchodzić się ze światłem stałym i błyskowym, zarówno w studio, jak i w plenerze, pracowałem z modelkami, modelami, jak i dziećmi podczas szkolnych sesji. Znam techniki postprodukcji takie jak frequency separation, dodge and burn i wiele innych, które stosowałem przy swoich pracach. Do pewnego momentu wydawało mi się, że mogę się dalej rozwijać zarówno jako fotograf, jak i twórca filmowy. Ale w końcu doszedłem do wniosku, że aby wznieść się na kolejny, wyższy poziom, trzeba się na czymś skupić. I tu wybór dla mnie był prosty, ponieważ w głębi serca zawsze dużo bardziej ciągnęło mnie jednak do świata filmu. On wzbudzał moją fascynację już od dziecka, chyba poprzez szersze pole manewru w kwestii środków wyrazu, choćby takich jak ruch i dźwięk.

ROLA FOTOGRAFII W FILMIE

Nie mniej jednak czuję, że zawdzięczam fotografii bardzo wiele, zwłaszcza jako operator. Myślenie “fotograficzne” pozwalające komponować kadry tak, a nie inaczej to wielki atut. Liczne warsztaty, zwłaszcza u Piotra Wernera, nauczyły mnie również myślenia o świetle, o kolorach i świadomego używania tych walorów. Tak zwany DP, czyli Director of Photography jest na planie drugim człowiekiem zaraz po reżyserze, a Oskary wręczane za zdjęcia należą do tych najbardziej prestiżowych. O roli fotografii w filmie niech świadczą ostatnie tytuły, takie jak “Diuna”, “Tragedia Makbeta” czy “West Side Story”, a nazwiska takich osób jak Roger Deakins czy Janusz Kamiński żadnemu fanowi kina nie powinny być obce.

PIOTR WERNER PHOTOGRAPHY

Już wspominałem Piotra, który od początku był dla mnie mentorem fotograficznym, a obecnie przyjacielem i osobą, z którą łączą mnie wspólne projekty. Piotr jest zdobywcą wielu prestiżowych nagród a przede wszystkim autorem fascynujących zdjęć, więc zachęcam do odwiedzenia jego strony www.piotrwerner.pl i oczywiście skorzystania z usług.

MOJE FOTOGRAFIE

A poniżej kilkanaście z moich fotografii.

Poradnik DaVinci Resolve #1

Niedawno w mediach społecznościowych rozpocząłem serię tzw. “szybkich porad” dotyczących DaVinci Resolve, natomiast tutaj na blogu będą się one pojawiać rzadziej, ale za to zebrane w nieco większą całość. Mam nadzieję, że okażą się interesujące, zapraszam do lektury części 1.

JAK ZARZĄDZAĆ MEDIAMI PO ZAKOŃCZENIU PROJEKTU?

Nowy projekt, przygotowania, zdjęcia, montaż, a na końcu szczęśliwy klient! A co potem? Na dysku zostaje masa plików, które nie będą już potrzebne, a może jednak? Jak skutecznie nimi zarządzać w DaVinci Resolve? Zdecydowanie polecam archiwizację projektu wraz z mediami, ale dla oszczędności miejsca tylko tymi, które faktycznie były użyte. Są przynajmniej dwie metody, aby zrobić to szybko i skutecznie:

- Metoda 1. W zakładce File otwieramy Media Management. To narzędzie ma zdecydowanie więcej możliwości, ale tu zależy nam na kopiowaniu plików z całego projektu, zatem w Entire Project wybieramy Copy, a następnie zaznaczamy Used media (można nawet przyciąć rzeczywiście wykorzystane części klipów z zakładkami – Used media and trim…). Dodatkowo zaznaczając Relink to new files wskazujemy nową lokalizację plików źródłowych, a następnie korzystając znów z zakładki File eksportujemy projekt (drp).

- Metoda 2. W Media Pool tworzymy Smart Bin wykorzystując atrybut Usage (is 0), ale jednocześnie wykluczamy pliki, takie jak Fusion, Timeline czy Still. Następnie te, które ostatecznie zostaną (czyli nie są nigdzie używane) usuwamy. W kolejnym kroku w oknie Project Manager tworzymy Project Archive (dra), który zawiera zarówno projekt, jak i pliki źródłowe i gotowe!

JAK PRZYŚPIESZYĆ PRACĘ W ZAKŁADCE COLOR?

Jedną z metod, które znacznie przyśpieszają pracę w zakładce Color, jest wprowadzanie zmian na wielu klipach jednocześnie. Jak zatem skorzystać z takiej możliwości?

- Zmiana z trybu Clip na Timeline. Standardowym trybem pracy w zakładce Color jest Clip, co oznacza, że wszelkie wprowadzane na Node’ach zmiany dotyczą danego klipu. Jeśli natomiast w prawym górnym rogu ekranu zmienimy tryb z Clip na Timeline, to zmiany na utworzonych wówczas Node’ach dotyczyć będą już całego Timeline, a więc wszystkich znajdujących się na nim klipów.

- Utworzenie grupy i praca w trybie Pre-Clip lub Post-Clip. Kolejną opcją jest zaznaczenie odpowiednich klipów (przynajmniej dwóch) i stworzenie grupy. Dzięki temu dla plików należących do grupy pojawiają się dodatkowe (poza Clip i Timeline) tryby; Pre-Clip oraz Post-Clip. Jak sama nazwa wskazuje zmiany na Node’ach w tych trybach będą wpływały na klipy z tej grupy odpowiednio przed i po zmianami w trybie Clip. Można tworzyć wiele grup, ale jeden klip może należeć tylko do jednej grupy.

Warto tu wspomnieć o kolejności w tzw. pipeline, która wygląda następująco: Pre-Clip -> Clip -> Post-Clip -> Timeline. Pre-Clip najczęściej służy do zmian związanych z przestrzenią kolorystyczną czy gamutem, Clip do normalizowania obrazu, ujednolicania poszczególnych klipów czy korekt lokalnych, Post-Clip do wprowadzania zmian kreatywnych, wreszcie w Timeline można dodać “końcowe” efekty, takie jak np. szum analogowy, choć wcale nie musi być to regułą.

- Praca w Remote Version. Inną opcją jest praca w Remote Version, która w odróżnieniu od Local Version, daje możliwość wprowadzania zmian na wszystkich klipach, które “pochodzą” z tego samego klipu “źródłowego” w Media Pool. Wyobraźmy sobie wywiad, który uzupełniamy o przebitki – na timeline tworzy się wiele części tego jednego długiego pliku i normalnie należałoby pracować na każdym z nich osobno. Dzięki Remote Version zmiany wprowadzane na jednym są automatycznie przenoszone na pozostałe.

To nie wszystkie możliwości w tym temacie, ale już znajomość powyższych może zaoszczędzić sporo czasu przy postprodukcji.

WYBRANE SKRÓTY KLAWISZOWE, KTÓRE WARTO ZNAĆ!

Skróty klawiszowe potrafią zdecydowanie przyśpieszyć pracę w wielu programach, a DaVinci Resolve nie stanowi tu wyjątku. Oto 10 wybranych skrótów, które naprawdę warto znać:

- Shift + Z – szybkie przeskalowanie Timeline do szerokości ekranu (i z powrotem).

- Alt + scroll – scrollowanie z wciśniętym klawiszem Alt skaluje Timeline.

- Shift + scroll – scrollowanie z wciśniętym klawiszem Shift zwiększa/zmniejsza wysokość ścieżek video (jeśli kursor znajduje się nad ścieżkami video) lub audio (jeśli kursor znajduje się nad ścieżkami audio).

- I oraz O – oznaczają odpowiednio wstawienie punktu początkowego (In) oraz końcowego (Out) zakresu klipu bądź Timeline.

- Alt + x – ten skrót z kolei oznacza usunięcie poprzedniego zaznaczenia zakresu.

- Alt + zaznaczenie – trzymając wciśnięty klawisz Alt, jeśli klip video posiada również ścieżkę audio – można zaznaczyć tylko część audio, lub tylko video (oczywiście można też wyłączyć opcję Linked Selection).

- D – zaznaczony klip po wciśnięciu D staje się niewidoczny (Disabled) i/lub wyciszony (Muted).

- Shift + zaznaczenie – z wciśniętym klawiszem Shift oraz przytrzymanym zaznaczeniem przesuwamy klip wyżej/niżej (klip przypadkowo nie przesunie się w lewo czy prawo).

- Alt + zaznaczenie – tym razem z wciśniętym klawiszem Alt, ale przesuwając zaznaczenie w lewo/prawo, lub ścieżkę wyżej/niżej, zaznaczony klip zostanie skopiowany. W taki sposób można duplikować również efekty przejścia.

- Alt + V – do kopiowania klipów można oczywiście skorzystać również ze standardowego skrótu Ctrl+C/Ctrl+V, ale czasem bardziej przydatne może okazać się kopiowanie samych atrybutów, takich jak Zoom, Position, itd. – wówczas zamiast Ctrl+V należy zastosować Alt+V, a pojawi się okno, które pozwoli zdecydować, które z atrybutów mają być przekopiowane.

A na koniec jeszcze jeden: Ctrl + Alt + K, który otwiera okno umożliwiające podgląd istniejących w programie skrótów (jest ich oczywiście o wiele więcej niż powyższe), oraz tworzenie własnych. Skróty klawiszowe znajdują również bardzo funkcjonalne zastosowanie w konsolach takich jak Loupedeck czy Elgato, gdzie całe makra można przypisać do jednego przycisku oznaczonego odpowiednią ikoną!